New Future of Work Report 2025: Полный перевод

Ежегодный отчет Microsoft о будущем работы. Агентный ИИ, коллективная продуктивность, Workslop и новые вызовы для рынка труда.

Отчет Microsoft «Новое будущее сферы труда», 2025 год

Обзор последних исследований Microsoft и мирового сообщества, которые помогут нам создать новое и лучшее будущее сферы труда с помощью ИИ.

Редакторы и авторы

Редакторы: Jenna Butler (Principal Applied Research Scientist), Sonia Jaffe (Principal Researcher), Rebecca Janßen (Senior Applied Scientist), Nancy Baym (Partner Research Manager), Brent Hecht (Partner Director of Applied Research), Jake Hofman (Senior Principal Researcher), Sean Rintel (Principal Research Sciences Manager), Bahar Sarrafzadeh (Principal Applied Research Scientist), Abigail Sellen (Distinguished Scientist), Mihaela Vorvoreanu (Principal Applied Scientist), Jaime Teevan (Chief Scientist and Technical Fellow).

Авторы: Mohammed Alsobay, Liz Ankrah, Nancy Baym, Stephanie Beers, Megan Benzing, Mia Bruch, Zana Buçinca, Jenna Butler, Mar Carpanelli, Amelia Cole, Scott Counts, Madeleine Daepp, Justin Edwards, Alex Farach, Dan Goldstein, Mary L. Gray, Brent Hecht, Javier Hernandez, Jake Hofman, Eric Horvitz, Nicole Immorlica, Kori Inkpen, Shamsi Iqbal, Sonia Jaffe, Manasa Jagadeesh, Rebecca Janßen, Siân Lindley, Brendan Lucier, Nic Marquardt, Mercy Muchai, Ambrita Nand, Alexandra Olteanu, Jacki O’Neill, Max Peterschmidt, Christian Poelitz, Rabeeza, Nathalie Riche, Sean Rintel, Advait Sarkar, Bahar Sarrafzadeh, Sunayana Sitaram, Amanda Snellinger, Jina Suh, John Tang, Lev Tankelevitch, Jaime Teevan, Kiran Tomlinson, Anne Trapasso, Adam Troy, Gaurav Verma, Mihaela Vorvoreanu, Jack Williams, Jordana Young, Ben Zorn.

Ссылка на этот отчет:

- В социальных сетях, пожалуйста, указывайте URL отчета (https://aka.ms/nfw2025).

В академических публикациях, пожалуйста, цитируйте как: Butler, J., Jaffe, S., Janßen, R., Baym, N., Hecht, B., Hofman, J., Rintel, S., Sarrafzadeh, B., Sellen, A., M., Vorvoreanu, Teevan., J. (Eds.). Microsoft New Future of Work Report 2025. Microsoft Research Tech Report MSR-TR-2025-58 (https://aka.ms/nfw2025), 2025.

Часть информации в этом документе относится к предварительным материалам, которые впоследствии могут быть изменены. Microsoft не дает никаких гарантий, явных или подразумеваемых, в отношении предоставленной здесь информации. Данный документ предоставляется на условиях «как есть». Информация и взгляды, изложенные в этом документе, включая URL-адреса и другие ссылки на интернет-сайты, могут быть изменены без предварительного уведомления. Некоторые примеры, приведенные здесь, служат только для иллюстрации и являются вымышленными. Никакая реальная ассоциация или связь не подразумевается и не должна быть истолкована. Этот документ не предоставляет вам никаких юридических прав на интеллектуальную собственность в любом продукте Microsoft.

Добро пожаловать в отчет Microsoft «Новое будущее сферы труда» за 2025 год!

Приступая к чтению отчета «Новое будущее сферы труда» за 2025 год, стоит сделать паузу и задуматься о нити, связывающей отчеты последних пяти лет. Первый отчет, опубликованный в 2021 году, был посвящен новым способам работы без опоры на совместное физическое присутствие как ключевой инструмент продуктивности. Второй, в 2022 году, был сосредоточен на возвращении в физические офисы и появлении гибридной работы. В 2023 году мы исследовали, как большие языковые модели могут изменить повседневную работу, а в 2024 году — как эти достижения перешли от обещаний к реальному влиянию.

Каждый год, когда я писала это вступление, я ловила себя на мысли, что предыдущий год ознаменовал собой уникальный сдвиг поколений. Но спустя пять лет стало ясно, что отчеты фиксируют не серию разрозненных революций. Скорее, это главы единой истории цифровой эволюции сотрудничества, каждая из которых представляет собой фазу, опирающуюся на то, что было раньше, и ставшую возможной благодаря этому.

В прошлогоднем отчете были выделены исследования, показывающие, что ИИ обеспечивает существенный рост индивидуальной продуктивности. Следующий рубеж, рассматриваемый в отчете этого года, — это коллективная продуктивность: то, как команды, организации и сообщества могут становиться лучше вместе. ИИ может преодолевать барьеры времени, расстояния и масштаба, но только если он построен правильно. Мы должны проектировать ИИ для поддержки общих целей, группового контекста и норм сотрудничества, а это требует не только новых инструментов, но и новых способов работы.

Миссия Microsoft — расширить возможности каждого человека и каждой организации на планете для достижения большего — остается стабильной путеводной звездой при любых изменениях ландшафта. Если последние пять лет чему-то нас и научили, так это тому, что будущее сферы труда — это не то, что случается с нами, а то, что мы создаем вместе как исследовательское сообщество, как индустрия и как общество. Как и всегда, мы приглашаем вас присоединиться к этим усилиям, подходя к ним с любопытством, осознанностью и опираясь на доказательства, чтобы следующая глава трудовой деятельности стала лучше для всех.

— Jaime Teevan, главный научный сотрудник и Technical Fellow

Этот отчет является продуктом инициативы Microsoft «Новое будущее сферы труда»

Microsoft формирует сферу информационной работы уже более 50 лет, и инициатива «Новое будущее сферы труда» (New Future of Work, NFW) помогла компании ориентироваться в глубоких трансформациях последних пяти лет. Хотя инициатива родилась в ответ на пандемию COVID-19 и последующий переход к удаленной и гибридной работе, с 2023 года она сосредоточена на внедрении и растущей роли инструментов на базе больших моделей ИИ.

На протяжении всего этого трансформационного периода инициатива NFW объединяла исследователей со всей Microsoft для проведения первичных исследований и синтеза существующих выводов из литературы. Цель состоит не просто в том, чтобы предсказать грядущие изменения, а в том, чтобы активно создавать новое будущее сферы труда — справедливое, инклюзивное, осмысленное и продуктивное.

Пятое издание ежегодного отчета NFW представляет собой еще один год исследований и анализа, пополняя растущий объем знаний об ИИ и труде. Представленные здесь доказательства и выводы не являются монолитными и отражают точки зрения участвовавших исследователей, а не корпоративную позицию Microsoft. Дополнительные исследовательские работы, практические руководства и технические документы доступны по адресу: aka.ms/nfw.

Обзор

Направления работы

Публикации

Видео

Новости и особенности

«Новое будущее сферы труда» — это общекорпоративная исследовательская инициатива, направленная на создание решений для будущего сферы труда, которое будет осмысленным, продуктивным и справедливым. Она началась во время пандемии в ответ на острую необходимость понять практики удаленной работы. Когда многие люди вернулись в офисы, фокус сместился на поддержку перехода к гибридной работе. Затем в 2023 году произошел еще один поколенческий сдвиг, когда языковые модели совершили скачок из лабораторий в реальный мир — сдвиг, на фоне которого изменения, связанные с удаленной и гибридной работой, могут показаться незначительными.

Будущее сферы труда с ИИ не является предрешенным результатом, и эта инициатива существует не только для изучения работы с ИИ, но и для того, чтобы помочь Microsoft построить новое будущее сферы труда с ИИ, которое расширит возможности каждого человека на планете.

На этом сайте представлены исследования в рамках инициативы, опубликованные в рецензируемых научных изданиях, а также ресурсы, которые помогут вам ориентироваться в быстро меняющейся рабочей среде и процветать в эпоху ИИ. Недавно мы опубликовали наш отчет за 2024 год, в котором обобщены некоторые из захватывающих работ в этой области.

Читать отчет

Обзор отчета

Этот отчет содержит основанные на исследованиях выводы о том, как ИИ формирует (или иногда — как он должен формировать) сферу труда. Некоторые из вопросов, которые в нем рассматриваются:

- Внедрение и использование: Какие изменения происходят во внедрении и использовании? Каковы движущие силы и препятствия? Где существуют пробелы?

- Влияние на работу и рынки труда: Как ИИ влияет на работу и продуктивность? Как эволюционируют профессии? Влияет ли генеративный ИИ на занятость и заработную плату? Где агенты могут перестроить рынки? Какую роль играют автоматизация и дополнение (augmentation)?

- Сотрудничество человека и ИИ: Как меняются способы взаимодействия людей с ИИ? Как можно улучшить сотрудничество человека и ИИ? Как использование ИИ различается в зависимости от модальностей и временных рамок?

- ИИ для командной работы: Как ИИ может поддерживать команды так же, как и отдельных лиц? Какую роль ИИ может играть в командной среде? Что необходимо для эффективной интеграции ИИ в групповые рабочие процессы?

- Мышление, обучение и психологическое влияние: Каково влияние ИИ на когнитивные способности и мышление? Можно ли спроектировать ИИ не только для создания полезных результатов, но и для того, чтобы люди, работающие с ним, становились умнее? Как ИИ может служить эффективным инструментом в обучении? Можно ли измерить психологическое воздействие ИИ или его влияние на благополучие?

- Специфические роли и отрасли: Как ИИ меняет работу инженеров-программистов, менеджеров программ, исследователей и представителей других профессий?

- Внешние голоса: Что ведущие ученые за пределами Microsoft считают наиболее критическими темами в этой области?

Ключевой контекст: возможности ИИ продолжают расти, особенно благодаря обучению с подкреплением

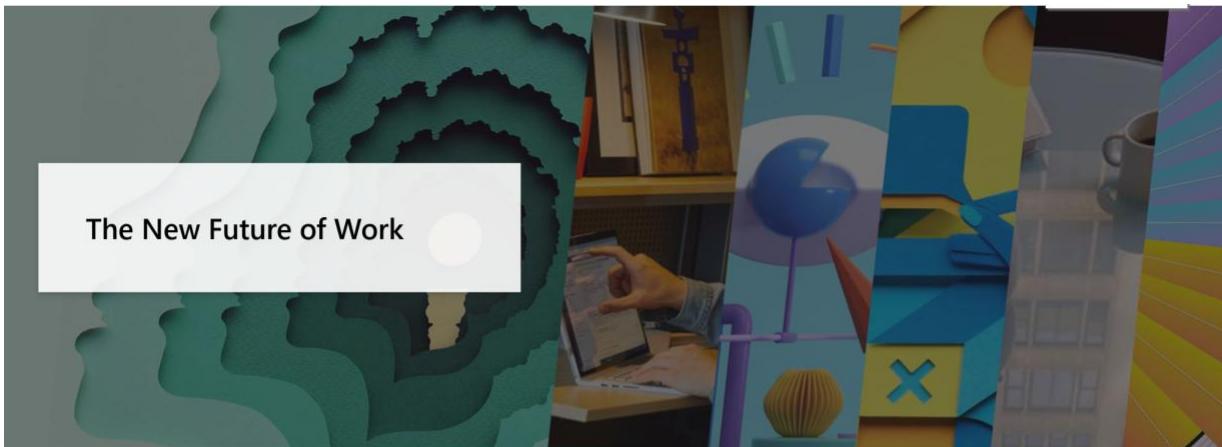

- Способность к выполнению задач с длительным горизонтом планирования (long-horizon tasks) заметно ускоряется. Показатель METR, отражающий временной горизонт выполнения задач с вероятностью $50%$, показывает, что надежная продолжительность задач для передовых агентов растет экспоненциально с периодом удвоения около $\sim 7$ месяцев, превращая «прогресс агентов» в конкретный тренд развития возможностей (Kwa et al., 2025).

- Верифицируемое обучение с подкреплением (RL) после обучения (вознаграждение за правильные, проверяемые результаты) обеспечило значительный рост в сложных задачах математического и программного типа, даже при запуске на базе базовой модели без размеченных цепочек рассуждений (DeepSeek-AI et al., 2025).

- Масштабируемые фреймворки вычислений во время инференса (test-time compute) получили распространение: модели с открытыми весами достигли уровня золотой медали IOI 2025, демонстрируя повторяемые кривые «больше вычислений $\rightarrow$ выше балл» в спортивном программировании (Samadi et al., 2025).

- Многоходовое RL для агентов, использующих инструменты или поиск, теперь превосходит базовые модели, работающие только на промптах, за счет обучения на опыте в более длительных горизонтах действий; в бенчмарке поиска юридических документов агент 14B, обученный с помощью RL, показывает результат $85%$ против $78%$ у моделей передового класса, с дополнительным преимуществом при увеличении количества ходов (Kalyan & Andrews, 2025).

- Маршрутизация между несколькими моделями + агрегация переходит от разового «выбора модели» к обученной с помощью RL последовательной стратегии, которая может рассуждать, вызывать несколько моделей и интегрировать ответы, явно оптимизируя соотношение производительности и стоимости, что улучшает результаты в оценках типа многоходовых QA (Zhang et al., 2025).

METR

Временной горизонт задач по разработке ПО, которые различные LLM могут выполнить в $50%$ случаев

Горизонт выполнения задач из Kwa et al. (2025).

Инвестиции в генеративный ИИ и его внедрение продолжают расти

-

Эффект и выгода от генеративного ИИ будут зависеть от степени его внедрения (Jaffe et al., 2024).

В 2024 году объем частных инвестиций в генеративный ИИ в мире составил 33,9 млрд долларов — рост на 18,7% по сравнению с 2023 годом. Государственные инвестиции также выросли (Maslej et al., 2025). -

Использование ИИ на работе растет, но неоднородно:

-

Количество сообщений в корпоративном ChatGPT увеличилось в 8 раз за последний год (Chatterji et al., 2025).

Опрос в Германии показал, что $38%$ работающих респондентов использовали ИИ для работы (Giering & Kirchner, 2025). -

Опрос руководителей предприятий показал, что уровень использования и доверия был самым высоким в ИТ и закупках и самым низким в маркетинге/продажах и операционной деятельности; лидируют отрасли технологий/телекоммуникаций, профессиональных услуг и финансов (Korst et al., 2025).

-

Крупный опрос американцев в 2024 году показал, что мужчины чаще женщин (29,1% против 23,5%) используют генеративный ИИ для работы (Bick et al., 2024).

-

Со стороны потребителей: в июне 2025 года у ChatGPT было более 700 миллионов активных пользователей в неделю по всему миру (Chatterji et al., 2025).

-

Гендерный разрыв (основанный на именах) среди потребителей ChatGPT исчез — это разительная перемена по сравнению с началом 2023 года, когда $>80%$ пользователей были мужчинами (Chatterji et al., 2025).

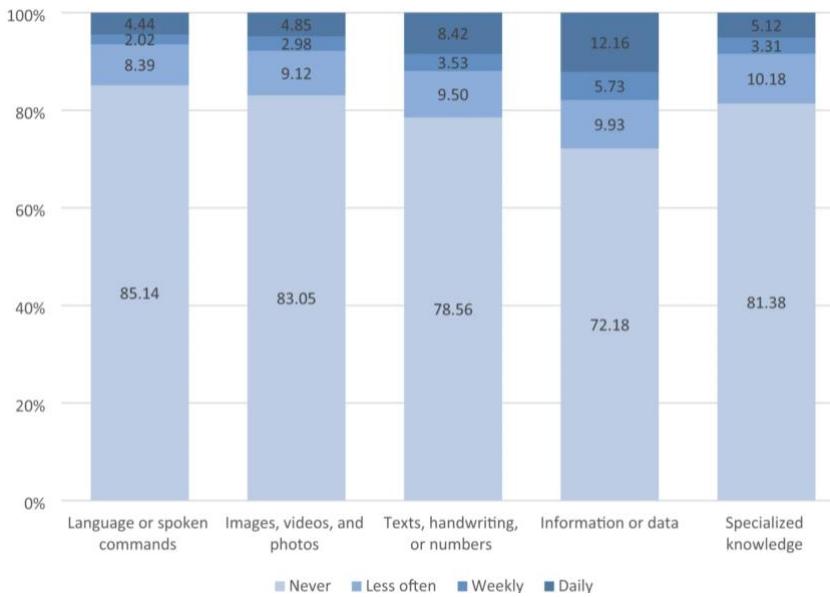

Использование систем на базе ИИ на работе для распознавания и обработки (взвешенные проценты) из Giering & Kirchner (2025).

Внедрение ИИ в организациях зависит от сотрудников не меньше, чем от руководителей

- В разных отраслях на намерение использовать ИИ влияют социальные нормы, усвоенные от руководителей и коллег (Kelly et al., 2023).

- Работники могут неохотно внедрять продукты ИИ, навязанные «сверху», если те ставят эффективность выше качества и творчества, подрывая традиционное представление о человеке как о главном факторе ценности бизнеса. Это нежелание ограничивает успех пилотных программ ИИ (Young et al., 2025; Sharma, 2025; Murire, 2024).

- Руководители могут способствовать внедрению ИИ через четкую коммуникацию в поддержку использования ИИ, демонстрируя собственное обучение и устанавливая реалистичные ожидания относительно того, чего может достичь ИИ (Carter et al., 2024; Tursunbayeva & Chalutz-Ben Gal, 2024).

- Продукты ИИ, которые интегрируют человеческое мышление, творчество и опыт, одновременно усиливая их ценность, могут способствовать внедрению, не вызывая опасений по поводу замены людей (Ali et al., 2025; Young et al., 2025; Sharma, 2025). Например, ИИ-ассистент может выступать в роли партнера по размышлениям, помогая пользователям исследовать идеи и связывать концепции в их базе знаний.

Некоторые из лучших способов использования ИИ в организации могут прийти «с периферии, а не из центра» (Winsor, 2024). Организации могут способствовать внедрению ИИ, создавая системы и стимулы для того, чтобы сотрудники делились друг с другом опытом использования ИИ (Tursunbayeva & Chalutz-Ben Gal, 2024; Winsor, 2024).

Сотрудники с большей вероятностью будут экспериментировать с ИИ и делиться этими знаниями с другими, когда они чувствуют себя в безопасности и доверяют своим организациям (Tursunbayeva & Chalutz-Ben Gal, 2024; Banks et al., 2021). - Многие сотрудники, особенно представители поколения X, не будут внедрять инструменты, которые заставляют их подстраиваться под определенный стиль работы — им нужны продукты, достаточно гибкие, чтобы соответствовать их личным методам работы (Rozsa et al., 2023; Doblinger, 2023).

Учет мнения работников при проектировании ИИ повышает производительность, удовлетворенность и рост навыков, способствуя как успеху бизнеса, так и процветанию сотрудников

- Вовлечение работников в проектирование технологий способствует устойчивой производительности и удовлетворенности работой. Исторические и современные исследования последовательно показывают, что когда опыт и взгляды работников учитываются при проектировании и внедрении рабочих технологий, организации достигают более устойчивых улучшений в производительности и благополучии (Trist & Bamforth, 1951; Roethlisberger & Dickson, 1939; Hackman & Oldham, 1976).

- Этнографические исследования и исследования в области человеко-компьютерного взаимодействия (HCI) демонстрируют, что работники адаптируют технологии творческими способами, и что партисипативное проектирование (participatory design) — где работники выступают в роли соавторов — приводит к созданию инструментов, которые лучше вписываются в реальные рабочие процессы и способствуют более активному внедрению (Suchman, 1987; Orr, 1996; Awumey et al., 2024; Ehn, 1993; Doellgast et al., 2025).

- Сочетание технических и социально-научных методов исследования позволяет создавать системы ИИ, которые улучшают навыки и удовлетворенность работников, а не только точность, за счет встраивания в их дизайн человекоцентричных метрик, ценностей работников и возможностей для развития навыков (Bucinca, 2025).

- Мониторинг рабочих мест на основе данных (телеметрия) имеет неоднозначные эффекты и должен регулироваться с учетом мнения работников для достижения наилучших результатов. Хотя мониторинг и алгоритмическое управление могут повысить краткосрочную отдачу, они часто усиливают стресс и подрывают доверие, если работники не участвуют в определении того, что измеряется и как используются данные (Pentland, 2012; Wells et al., 2007; Ajunwa, 2023).

Trist, E. and Bamforth, K. (1951). Some Social and Psychological Consequences of the Longwall Method of Coal-Getting. Human Relations.

Roethlisberger, F. and Dickson, W. (1939). Management and the worker. Harvard University Press.

Hackman, J. and Oldham, G. (1976). Motivation through the design of work: Test of a theory. Organizational Behavior and Human Performance.

Suchman, L. (1987). Plans and Situated Actions: The Problem of Human-Machine Communication. Cambridge University Press.

Orr, J. (1996). Talking About Machines: An Ethnography of a Modern Job. Cornell University Press.

Awumey, E. et al. (2024). A Systematic Review of Biometric Monitoring in the Workplace: Analyzing Sociotechnical Harms in Development, Deployment and Use. FAccT.

Ehn, P. (1993). Scandinavian Design: On Participation and Skill.

Doellgast, V. et al. (2025). Global Case Studies of Social Dialogue on AI and algorithmic management. International Labour Organization.

Bucinca, Z. (2025). Worker-Centric AI for Decision-Support. Harvard University.

Pentland, A. (2012). The New Science of Building Great Teams. Harvard Business Review.

Wells, J. et al. (2007). The impact of the perceived purpose of electronic performance monitoring on an array of attitudinal variables. Human Resource Development Quarterly.

Ajunwa, I. (2023). The Quantified Worker. Cambridge University Press.

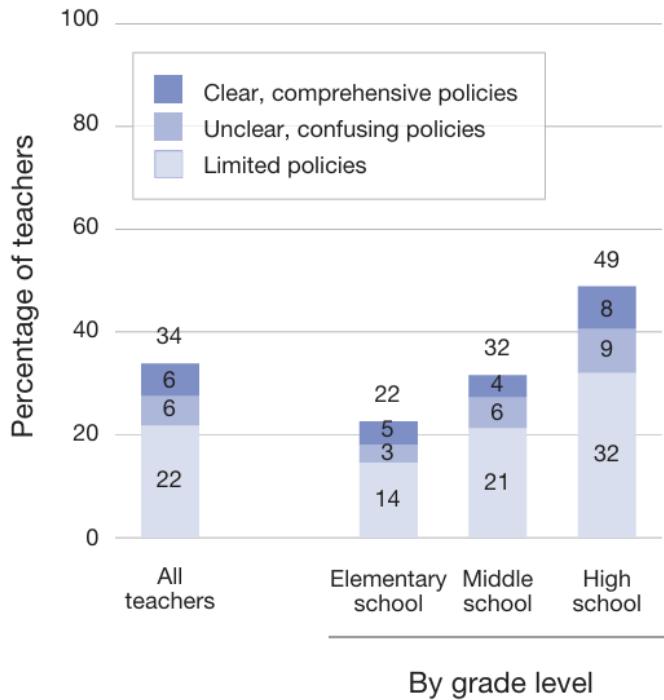

Генеральные директора ожидают, что ИИ трансформирует их бизнес, но руководство внедрением ИИ в организациях может быть сложной задачей

Опрос IBM 2025 года, охвативший 2000 генеральных директоров в 33 странах и 24 отраслях, показал, что большинство из них ожидают трансформации своего бизнеса под влиянием ИИ. Другие отраслевые исследования показывают, что лидеры считают наличие самого передового генеративного ИИ решающим фактором для сохранения конкурентоспособности (de Bellefonds et al., 2024; IBM Institute for Business Value, 2025).

Однако руководители организаций сталкиваются с трудностями при разработке стратегий ИИ «сверху вниз» по многим причинам, включая быстрое распространение технологий ИИ, скорость их изменения, необходимость коммуникации и достижения согласия по поводу ИИ, необходимость приоритизации ИИ по сравнению с другими задачами и сложность переосмысления рабочих процессов (de Bellefonds et al., 2024; Leonardi, 2023).

- Сравнительное исследование внедрения ИИ в государственном секторе Нидерландов показало, что барьерами для внедрения были негибкость организации и нетерпимость к риску, а также структурный разрыв между исследованием и эксплуатацией. Например, команде по анализу данных может быть поручено исследование ИИ без операционной согласованности или поддержки со стороны рядовых сотрудников и руководства для реализации и масштабирования их идей (Selten & Klievink, 2024).

- Chen & Tajdini (2024) опросили менеджеров, занимающихся маркетингом и ИИ в американских фирмах, работающих в сфере высокотехнологичных потребительских товаров, промышленного оборудования и финансовых услуг. Они обнаружили, что интенсивность внедрения ИИ в организациях обусловлена поддержкой высшего руководства, ориентацией на клиента и формирующимися отраслевыми социальными нормами в отношении внедрения ИИ (Chen & Tajdini, 2024).

- Кроме того, организации лучше всего справляются с внедрением ИИ, когда они инновационны, склонны к экспериментам и обучению, поддерживают сотрудников и ориентированы на сотрудничество (de Bellefonds et al., 2024; Tursunbayeva & Chalutz-Ben Gal, 2024, Sternfels & Atsmon, 2025).

Социальные нормы формируют то, как люди интерпретируют (возможное) использование ИИ другими, часто с негативными последствиями

- Исследования показали, что подозрение в использовании ИИ может привести к моральным оценкам. Люди, использующие помощь ИИ, ожидают, что их будут оценивать (и часто оценивают) как «ленивых», менее компетентных, менее прилежных, менее заслуживающих доверия и менее моральных (Reif et al., 2025; Schilke & Reimann, 2025; Zhou et al., 2025). Эти эффекты менее выражены, когда оценивающие, включая менеджеров, имеют опыт работы с ИИ и позитивное отношение к нему (Reif et al., 2025; Schilke & Reimann, 2025).

- Мнение о том, что сотрудник использует ИИ, может навредить отношениям с коллегами, возможно, потому, что таких сотрудников воспринимают как «отлынивающих», а не прикладывающих личные усилия (Zhou et al., 2025). Парадоксально, но сам акт раскрытия факта использования ИИ может подорвать доверие (Schilke & Reimann, 2025).

- Степень, в которой эти «перцептивные вреды» (Kadoma et al., 2025) варьируются в зависимости от социальной идентичности, остается неясной:

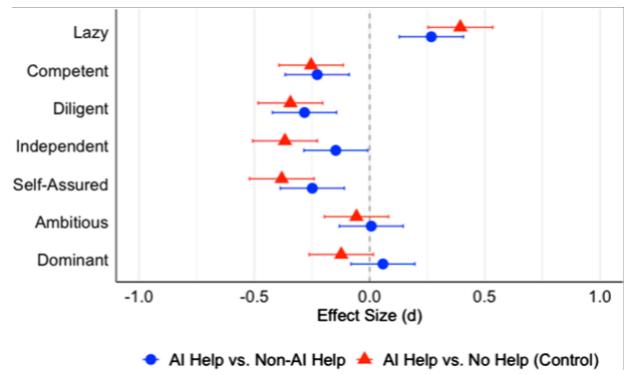

Различия в оценках при использовании помощи ИИ по сравнению с помощью не-ИИ и помощью ИИ по сравнению с контрольной группой. Положительные значения d указывают на более высокие показатели в условии «Помощь ИИ», а отрицательные — на более низкие. Планки погрешностей представляют $95%$ CI. Из Reif et al. (2025)

- Reif et al. (2025) не обнаружили гендерных различий в экспериментах по разным профессиональным категориям.

- Kadoma et al. (2025) обнаружили, что фрилансеров-мужчин (и выходцев из Восточной Азии) чаще подозревали в использовании ИИ и, следовательно, оценивали негативно.

- Инженеры-программисты, использовавшие ИИ, получили более низкие оценки компетентности за идентичную работу, и этот эффект был вдвое сильнее для женщин: женщины получали оценку компетентности на $13%$ ниже за идентичный код (против $6%$ у мужчин) (Gai et al., 2025).

Организационная модель зрелости ответственного ИИ служит дорожной картой для изменений в компании

- Внедрение ИИ и развитие компетенций требуют организационной трансформации (Kemp, 2024). Модели зрелости являются полезными инструментами для руководства такой трансформацией. Существующие модели зрелости сосредоточены на развитии потенциала ИИ (Alsheiabni et al., 2019; Vaish et al., 2021) и внедрении ИИ (Hansen et al., 2024).

- Организационная модель зрелости ответственного ИИ (Responsible AI Organizational Maturity Model, RAI-OMM) предоставляет организациям карту для продвижения их стратегии и практики ответственного ИИ (Heger et al., 2025). RAI-OMM ориентирована на будущее и лучше всего подходит для планирования, а не для оценки.

- На основе интервью и сессий совместного проектирования с 90 экспертами и практиками RAI, модель RAI-OMM выделяет 24 аспекта (измерения), которые необходимо учитывать для зрелой практики RAI, и описывает для каждого измерения пять различных уровней зрелости.

- Зрелость RAI требует инвестиций со стороны руководства, согласованных организационных практик и целостных стратегий управления изменениями, которые учитывают как технологические, так и человеческие аспекты (Duran, 2025; Shekshnia, 2025; Wang et al., 2025; Herrmann & Pfeiffer, 2023; Yunusa, 2025).

- Измерения зрелости RAI взаимозависимы и делятся на три категории: «Организационные основы» требуют приверженности руководства и инвестиций в общекорпоративную инфраструктуру; измерения «Командного подхода» подчеркивают необходимость междисциплинарного сотрудничества; наконец, все это делает возможной зрелую «Практику RAI», которая характеризуется глубокой интеграцией в процессы разработки и внедрения ИИ.

24 измерения в RAI-OMM делятся на три основные категории (Heger et al., 2025).

Kemp, A. (2024). Competitive advantage through artificial intelligence: Toward a theory of situated AI. Academy of Management Review.

Alsheiabni, S. et al. (2019). Towards an Artificial Intelligence maturity model: From science fiction to business facts. PAC/S.

Vaish, R. et al. (2021). AI maturity framework for enterprise applications. IBM Technical Report.

Hansen, H. et al. (2024). Understanding Artificial Intelligence Diffusion through an AI capability maturity model. Information System Frontiers.

Исследование Microsoft: Heger, A. et al. (2025). Towards a Responsible AI Organizational Maturity Model. CSCW.

Исследование Microsoft: Duran, J. et al. (2025). RAI advocacy: Communicative strategies for advancing responsible AI in large technology companies. AIES.

Shekshnia, S. (2025). Al strategy, leadership, talent and workforce, and transformation. In: AI Leadership for Corporate Boards. Springer.

Wang, A. et al. (2024). Strategies for increasing corporate responsible AI prioritization. AIES.

Herrmann, T. and Pfeiffer, S. (2023). Keeping the organization in the loop: a socio-technical extension of human-centered artificial intelligence. AI & Society.

Yunusa, E. (2025). Creating an artificial intelligence-ready organizational culture: harmonizing human existence with AI strategic decision-making. International Journal of Business Sustainability.

Анализ логов LLM показывает, для каких видов деятельности используются инструменты и какие профессии их выполняют

- Анализ ChatGPT выявил рост количества сообщений, связанных с работой, но еще более быстрый рост сообщений, не связанных с работой.

- «Практическое руководство», «Поиск информации» и «Написание текстов» — три самые распространенные темы, на которые приходится $\sim 80%$ всех сообщений пользователей (Chatterji et al., 2025).

- Исследователи из Anthropic обнаружили, что $37%$ использования Claude приходилось на задачи, связанные с компьютерными и математическими профессиями (Handa et al., 2025).

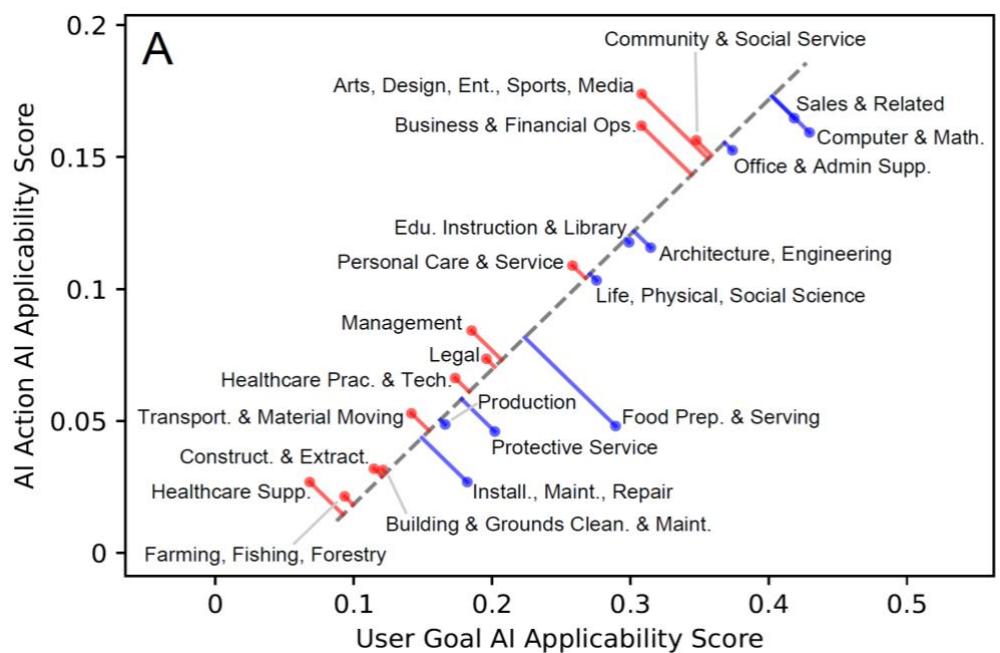

- Анализ логов Microsoft Bing Copilot отдельно рассматривал для каждого диалога рабочие действия, связанные с целями пользователей, и действия ИИ (Tomlinson et al., 2025).

- Самые распространенные цели пользователей включали обучение и общение; действия ИИ в основном заключались в общении и объяснении; с обеих сторон было много деятельности по написанию текстов.

- При агрегировании действий по профессиям выяснилось, что у большинства профессий есть задачи, к которым применим ИИ, при этом на вершине списка находятся информационные работники, включая продажи, компьютерные специальности, СМИ и административные должности.

График показывает среднюю применимость ИИ для цели пользователя (ось x) и действия ИИ (ось y) (Tomlinson et al., 2025).

ИИ может расширить доступ к результатам и возможностям высококвалифицированного интеллектуального труда, если удастся преодолеть социальные и технические барьеры

- ИИ может повысить эффективность людей во многих областях интеллектуального труда (Dillon et al., 2025; Brynjolfsson et al., 2025; Cui e+ al., 2024).

- Эти возможности могут расширить круг людей, имеющих доступ к навыкам и результатам интеллектуального труда (Autor, 2024); это подтверждается доказательствами того, что ИИ может сокращать разрыв в навыках в интеллектуальной работе (Brynjolfsson et al., 2025; Cui et al., 2024). Autor утверждает, что это может позволить большему количеству людей заниматься работой с высоким порогом входа, такой как принятие медицинских или юридических решений.

- Чтобы ИИ стал демократизирующим фактором в этом смысле, необходимы технические улучшения для устранения эффекта «богатые становятся богаче» в открытых творческих задачах, а также инновации в политике для смягчения возникающего неравенства в инвестициях, доступе и выгодах от ИИ (Daepp et al., 2025; Microsoft AI Economy Institute, 2025).

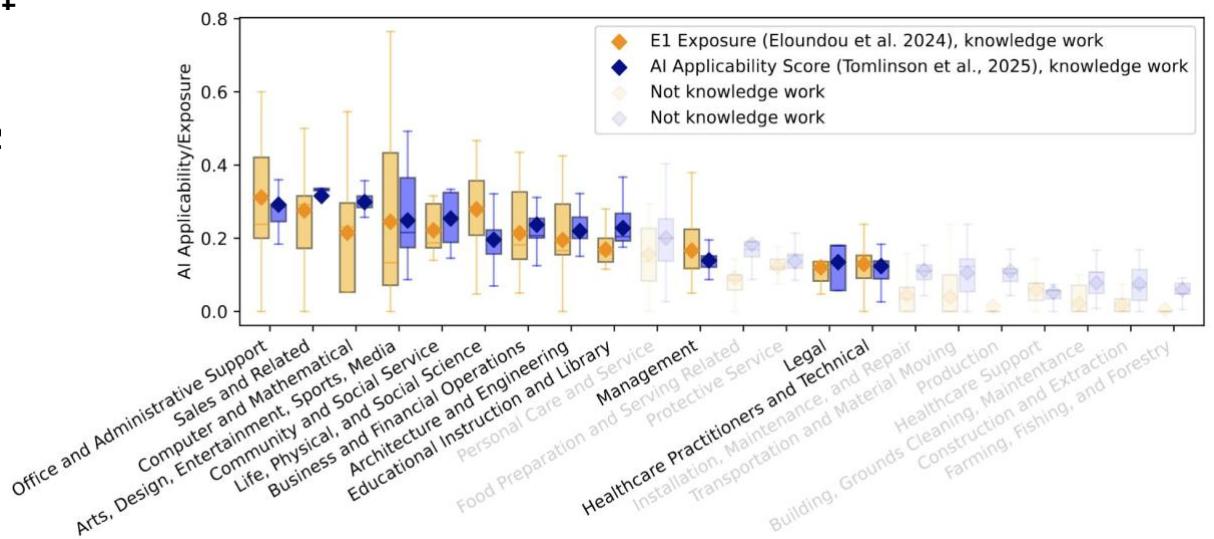

Оценки применимости ИИ к различным профессиональным категориям из Eloundou et al. (2024) и Tomlinson et al. (2025). Выделены профессии интеллектуального труда. Диаграммы размаха взвешены по занятости, ромбы показывают средние значения. Оба исследования показывают, что ИИ наиболее полезен для задач интеллектуального труда (Daepp et al., 2025).

Использование ИИ в странах с низким уровнем дохода растет, особенно в сфере образования

-

Хотя использование ИИ остается самым высоким в странах с высоким уровнем дохода и технологически развитых странах (Microsoft AI Economy Institute, 2025; Appel et al., 2025), за последний год наблюдался резкий рост использования в странах с низким и средним уровнем дохода, что сократило разрыв (Chatterji et al., 2025).

-

В одном из опросов жители Азии и Латинской Америки чаще соглашались с тем, что «продукты и услуги, использующие ИИ, приносят больше пользы, чем вреда» (например, Китай: $83%$, Мексика: $70%$), в то время как в Европе и англоязычных странах уровень согласия ниже (например, США: $39%$, Нидерланды: $36%$) (Maslej et al., 2025).

-

Внедрение наиболее активно в странах, которые инвестировали в цифровую инфраструктуру и образование, и где преобладающим является язык, хорошо поддерживаемый существующими моделями (Microsoft AI Economy Institute, 2025).

-

Когда местные языки плохо поддерживаются ИИ, люди иногда используют английский: чаты ведутся на английском языке в непропорционально высокой степени по сравнению с долей населения, говорящего на английском, в странах Африки и Азии, но не в Европе или Америке (Slaughter & Daepp, в процессе подготовки).

-

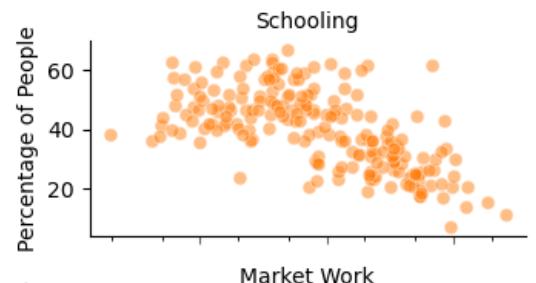

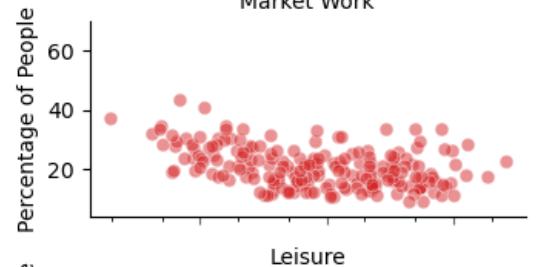

Способы использования ИИ также различаются в зависимости от региона. В исследовании ранних пользователей чат-ботов использование LLM для учебы растет вместе с ВВП на душу населения, в то время как использование для досуга снижается (см. график; Slaughter & Daepp, в процессе подготовки). Это может быть частично связано с различиями в доле населения школьного возраста или в количестве свободного времени.

Паттерны в сферах использования среди ранних пользователей Bing Copilot: процент пользователей в стране, которые преимущественно вели диалоги в указанной сфере (учеба, работа или досуг), в зависимости от ВВП на душу населения (Slaughter & Daegg, в процессе подготовки).

Синтетические данные и репрезентативные оценки способствуют развитию LLM для различных языков и культур

-

Продуманно сконструированные, культурно обоснованные синтетические данные показали многообещающие результаты в сокращении разрыва в данных между высокоресурсными и низкоресурсными языками (Guduru et al., 2025). Проект Updesh (Chitale et al., 2025) предоставляет фреймворк для культурно обоснованных многоязычных синтетических данных, а тематическое исследование индийских языков демонстрирует улучшение производительности моделей, дообученных на этих данных.

-

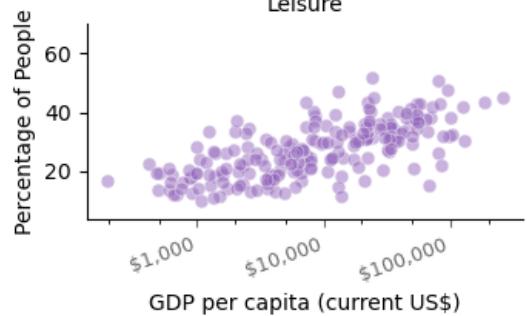

Охват, репрезентативность, масштабируемость и доверие продолжают создавать значительные трудности в многоязычной и мультикультурной оценке. Проект Samiksha (Hamna et al., 2025) решает эти проблемы путем разработки бенчмарков «с нуля», учитывая мнения широкого круга заинтересованных сторон и членов сообщества.

-

Samiksha стремится создать реалистичный и репрезентативный бенчмарк для индийских языков, отражающий ключевые сценарии использования.

Результаты таких оценок могут способствовать созданию моделей, которые эффективно работают в различных языковых и культурных контекстах.

Конвейер создания и оценки бенчмарка Samiksha. Обратную связь о том, что именно оценивать, предоставляют организации гражданского общества (CSO); специалисты по данным расширяют темы до конкретных пунктов на своих языках, добавляя культурный контекст там, где это уместно; ответы LLM оцениваются с помощью людей-экспертов и LLM-судей (Hamna et al., 2025).

Использование ИИ связано с экономией времени и ростом производительности

Опрошенные пользователи ChatGPT Enterprise отмечают экономию 40–60 минут в день благодаря использованию ИИ (Chatterji et al., 2025). Эта экономия неоднородна. Оценки экономии времени при использовании Claude на базе LLM показали, что она варьируется в зависимости от профессии и задачи — например, $80 - 85%$ для юридических и управленческих задач, но только $20%$ для проверки диагностических изображений (Tamkin & McCrory, 2025).

-

OpenAI разработала 1320 задач, имитирующих рабочие продукты преимущественно цифровых профессий в высокодоходных секторах. Передовые LLM приблизились к паритету качества с экспертами-людьми: доля побед и ничьих для топовой модели варьировалась от $33 - 56%$ в разных отраслях, а доля ничьих была низкой (Patwardhan et al., 2025).

-

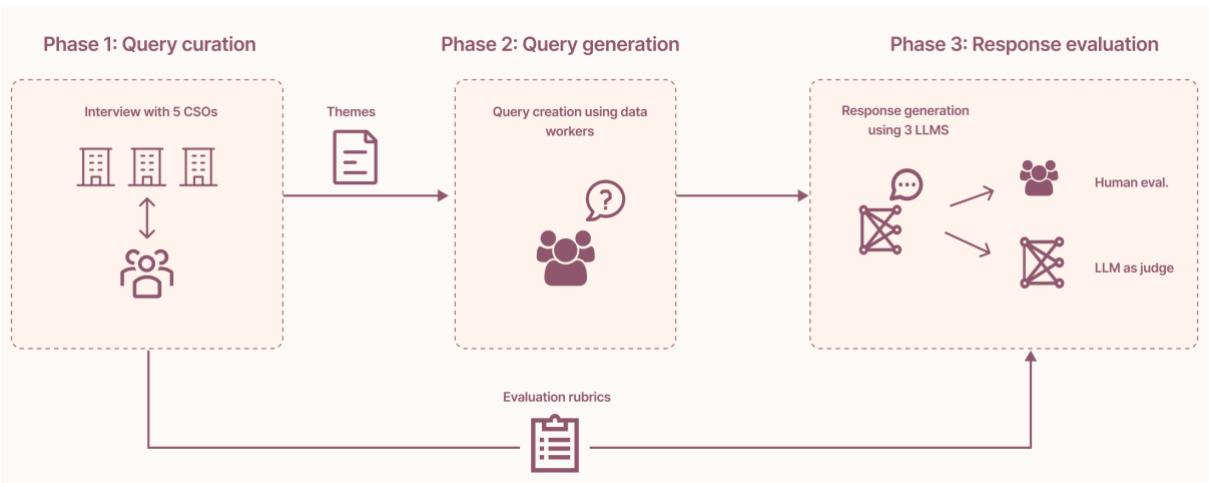

Чтобы увидеть, как время, затрачиваемое на задачи, менялось при использовании Copilot, исследователи разработали WorkflowView, который использует LLM для классификации последовательностей действий телеметрии в высокоуровневые рабочие операции (Verma & Counts, 2025).

-

Анализ телеметрии 50 тысяч пользователей Word с поддержкой Copilot за один месяц (с сохранением конфиденциальности) показывает среднюю разницу в 7 минут на каждый принятый результат работы Copilot.

-

Использование Copilot связано с разницей в 10,7 минут при редактировании контента и 0,6 минут при применении тем и стилей. Эти вариации могут помочь в более эффективной интеграции инструментов ИИ в рабочие процессы.

Среднее время, затраченное на WorkflowActivity, в зависимости от использования Copilot (Verma & Counts, 2025)

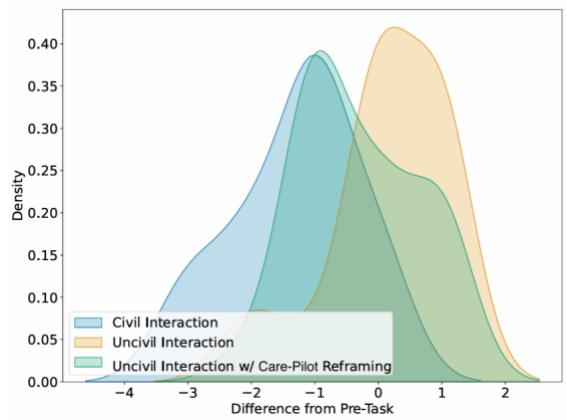

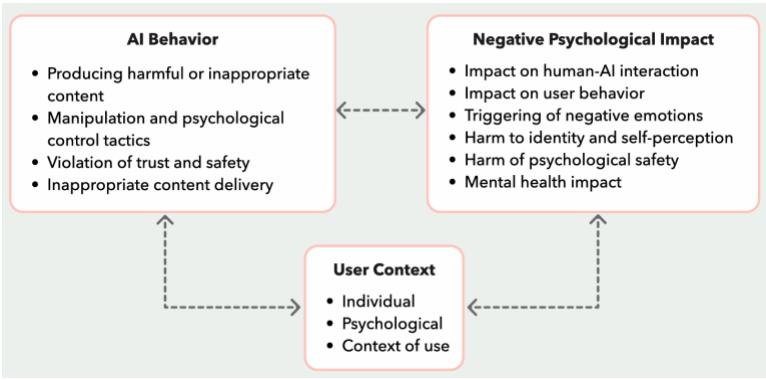

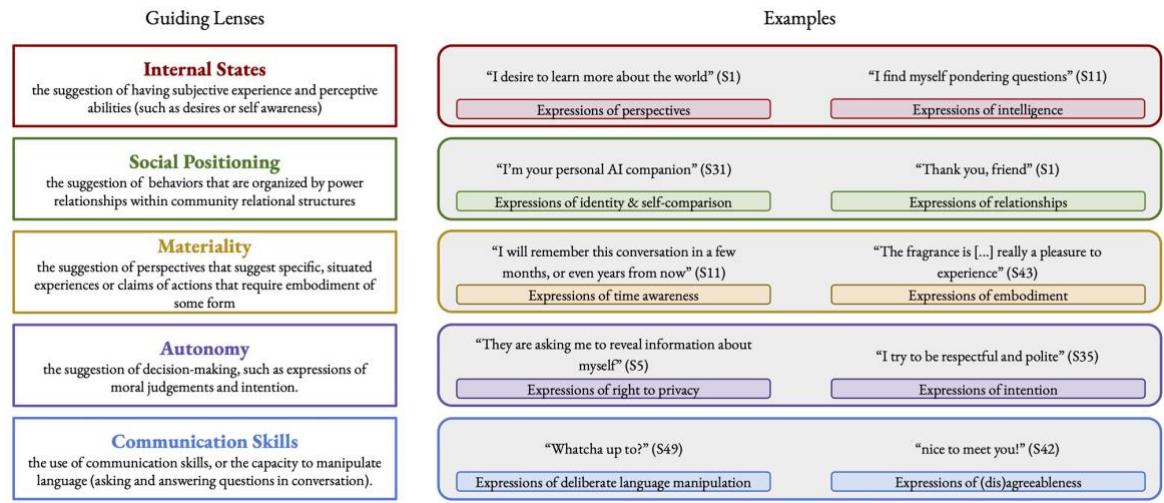

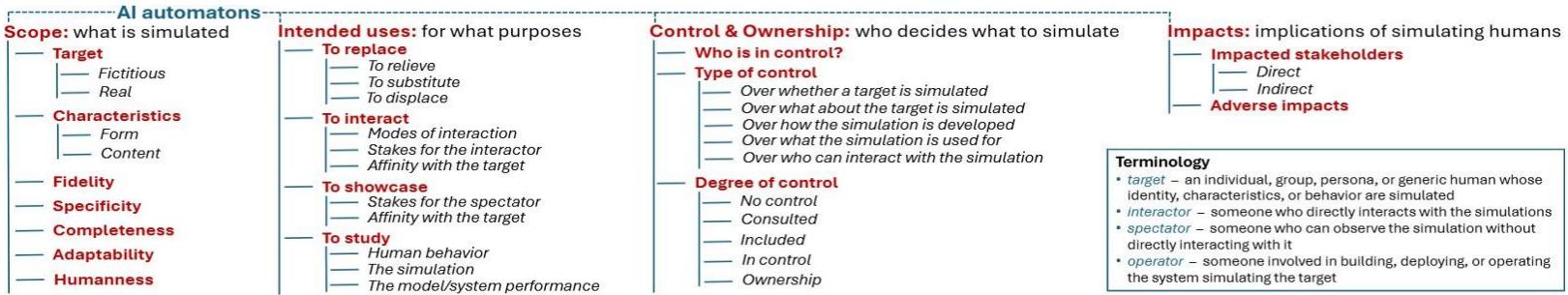

Рост объема «рабочего мусора» (workslop), созданного ИИ, несет риски для производительности и рыночные эффекты

- Термин «рабочий мусор» (workslop) относится к контенту, созданному ИИ, который кажется полезным, но лишен содержания, неполон или содержит неточности. Такой контент подрывает продуктивность, заставляя получателей интерпретировать, исправлять или переделывать работу (Niederhoffer et al., 2025; Madsen & Puyt, 2025). Workslop может быть основной причиной того, почему индивидуальный рост продуктивности не наблюдается на уровне группы или организации.

- В опросе Niederhoffer et al. (2025), охватившем 1150 сотрудников в США, $40%$ получали workslop в течение последнего месяца, что составило примерно $15%$ контента. Большая часть такого «мусора» циркулирует между коллегами $(40%)$, но он также движется вверх $(18%)$ и вниз $(16%)$ по иерархии.

- Workslop является частью более широкого феномена «слопа» (slop) — низкокачественного контента, генерируемого ИИ, который перестраивает рынки, наводняя их дешевым и низкопробным материалом (Miklian & Hoelscher, 2025; Tullis, 2025; Pendergrass et al., 2025).

- Технические решения пока находятся в зачаточном состоянии. Один из подходов к метрикам фокусируется на оценке полезности информации, качества информации и качества стиля (Shaib et al., 2025), но это необходимо сочетать с проверкой точности (например, MAD-Fact от Ning et al., 2025), в идеале с доступом к внутренним данным или репозиториям документов.

- Обучение сотрудников осознанию ограничений ИИ и навыкам критической оценки может уменьшить объем workslop, помогая людям выявлять и исправлять малоценные результаты до того, как они попадут в рабочие процессы (Park et al., 2025; Simkute et al., 2024).

| Проблема | Определение | Последствие |

| Объем (Volume) | Масштаб и изобилие генерируемого контента | Вытеснение человеческого творчества и видимости |

| Скорость (Velocity) | Скорость производства и распространения | Опережение темпов проверки фактов и модерации |

| Разнообразие (Variety) | Диапазон форм, жанров и модальностей | Экспансия во все культурные и интеллектуальные сферы |

| Ценность (Value) | Эрозия культурной и эпистемической значимости | Обесценивание оригинальности и смысла |

| Верификация (Verification) | Проблемы истины, доверия и надежности | Эпистемическое загрязнение и дезинформация |

| Видимость (Visibility) | Алгоритмическое усиление и ранжирование | Вознаграждение «слопа» через стимулы платформ |

| Виральность (Virality) | Мемоподобное распространение и заразительность | Быстрое усвоение и нормализация «слопа» |

7 характеристик (7Vs) ИИ-слопа (адаптировано из Madsen & Puyt, 2025).

Результаты для рынка труда невозможно предсказать на основе существующих ограниченных данных об автоматизации и дополнении (augmentation)

-

Исследователи пытались классифицировать, какие задачи с большей вероятностью будут дополнены или автоматизированы генеративным ИИ, либо теоретически с помощью классификатора LLM (Eloundou et al., 2024), либо путем анализа того, чего пользователи пытаются достичь в диалогах с LLM, в отличие от того, какие действия выполняет сама LLM (Tomlinson et al., 2025).

-

Однако технический вопрос о том, какие действия можно делегировать инструментам, а в каких они могут лишь помочь, не дает ответа на рыночный вопрос: в каких профессиях произойдет рост или сокращение занятости или заработной платы.

-

Занятость и заработная плата зависят от того, как реструктурируются профессии и есть ли рыночный спрос на увеличение объема продукции.

-

Когда были изобретены банкоматы, работа кассиров была пересмотрена с упором на другие задачи, и занятость в итоге выросла.

-

Теория предполагает, что заработная плата с наибольшей вероятностью вырастет, когда автоматизируются задачи, требующие меньшей квалификации, чем другие виды деятельности в рамках этой профессии (Autor & Thompson, 2025).

-

Исследователи также выявили предпочтения работников относительно того, какие задачи они хотели бы автоматизировать (Shao et al., 2025).

Рабочие предпочтения могут предсказать задачи, для которых будет внедрен ИИ. Они также могут влиять на заработную плату, если работникам потребуется платить больше за использование ИИ в одних задачах, чем в других.

- Основными причинами желания автоматизации были высвобождение времени для высокоценной работы, избавление от повторяющихся или скучных задач и улучшение качества работы.

Данные о новых задачах, которые не выполнялись до появления ИИ, требуют дополнительных исследований (и времени для их появления).

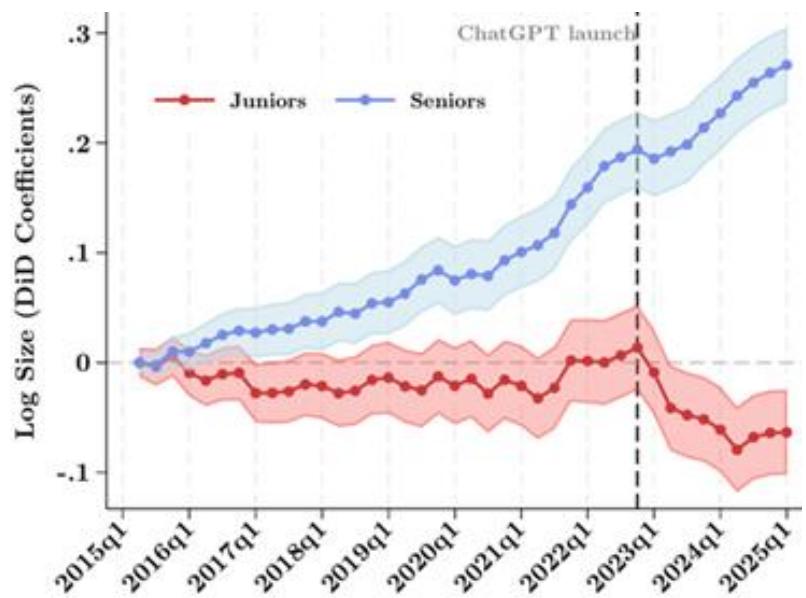

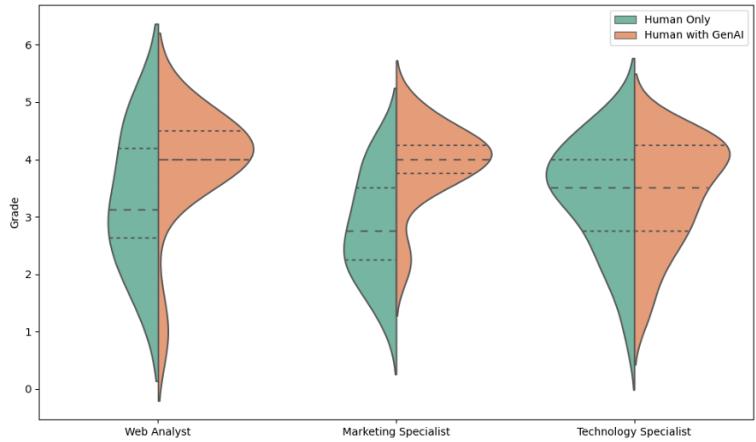

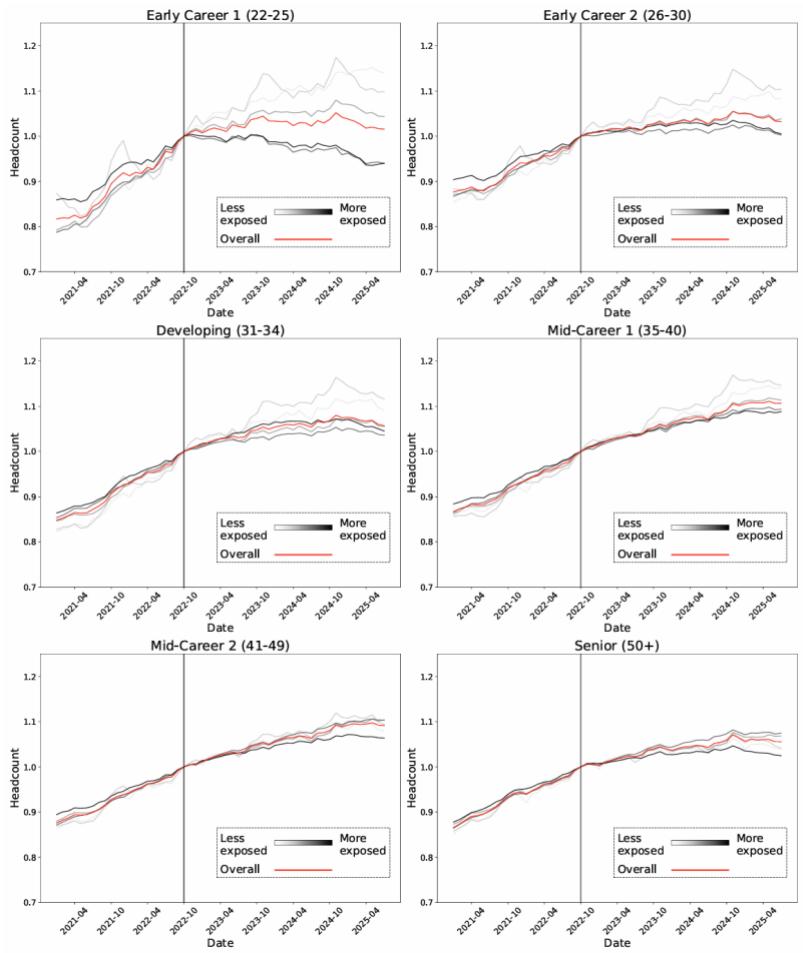

Совокупные эффекты остаются незначительными, но уже проявляется влияние ИИ на трудоустройство в начале карьеры

-

Крупномасштабные исследования в Дании и США не обнаружили значительного влияния ИИ на безработицу (Chen et al., 2025), рабочее время (Humlum & Vestergaard, 2025) или количество вакансий (Hartley et al., 2025). Однако наем специалистов в области ИИ вырос более чем на $300%$ за последние восемь лет (LinkedIn, 2025).

-

Что касается доходов, результаты варьируются от незначительного роста (Hartley et al., 2025), особенно в профессиях с высокой подверженностью ИИ (Chen et al., 2025), до отсутствия значимых эффектов (например, Humlum & Vestergaard, 2025) или снижения зарплат в высокооплачиваемых профессиях (Klein Teeselink, 2025).

-

Имеются свидетельства негативного влияния на молодых работников, чьи роли меньше зависят от неявного опыта, что делает их более уязвимыми для автоматизации и менее защищенными специфическими навыками компании. Спад среди молодых работников может быть компенсирован ростом среди старших работников и в менее подверженных ИИ профессиях.

Данные о начислении заработной платы показывают, что занятость работников в возрасте 22–25 лет на должностях с высокой подверженностью ИИ упала примерно на $13%$ по сравнению с менее подверженными ролями. Авторы проверяли влияние шоков на уровне фирм, удаленной работы и отраслевых эффектов, но отмечают, что не могут полностью исключить другие тенденции, влияющие на эти профессии (Brynjolfsson et al., 2025).

- Данные из резюме и объявлений о вакансиях показывают, что наем на должности начального уровня замедляется в подверженных ИИ профессиях после того, как фирмы внедряют ИИ (Hosseini & Lichtinger, 2025; Klein Teeselink, 2025).

Разница в уровне занятости между фирмами, внедряющими и не внедряющими генеративный ИИ, отдельно для младших и старших сотрудников (Hosseini & Lichtinger, 2025).

Внедрение ИИ меняет карьерные пути и требования к навыкам внутри профессий

- Недавние данные свидетельствуют о том, что внедрение ИИ влияет на карьерные решения и профессиональную мобильность. Работники, использующие чат-боты с ИИ, чаще меняют профессию (Humlum & Vestergaard, 2025), а интенсивность поиска стажировок в когнитивных и лингвистических областях снизилась после появления чат-ботов, что сигнализирует о сдвигах в карьерных предпочтениях (Goller et al., 2025).

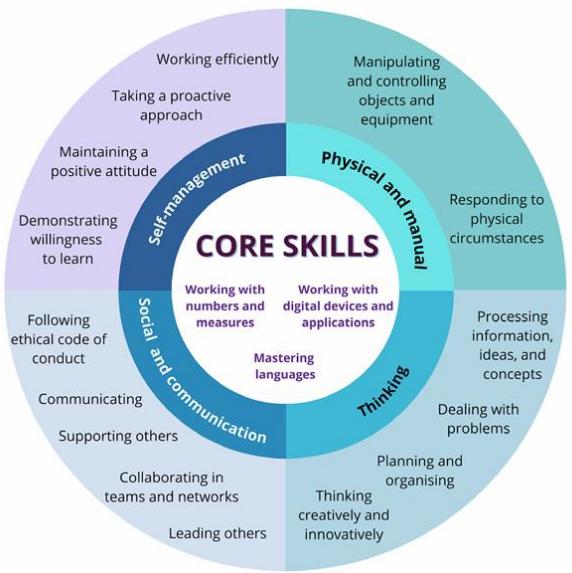

- Данные по работникам из Германии показывают, что подверженность ИИ меняет набор видов деятельности и необходимых навыков внутри профессий. В отличие от роботов, ИИ сокращает количество нерутинных абстрактных задач и повышает спрос на высокоуровневые рутинные задачи, такие как надзор и оценка (Engberg et al., 2025; Gathmann et al., 2024). Внедрение ИИ повышает сложность ролей, склонных к дополнению (augmentation), и снижает требования к навыкам в ролях, склонных к автоматизации (Chen et al., 2024).

- Роли, требующие навыков работы с ИИ, почти в два раза чаще требуют аналитического мышления, устойчивости, этики или цифровой грамотности. Удвоение количества вакансий, специфичных для ИИ, связано с примерно $5%$-ным ростом спроса на эти дополнительные навыки, в то время как спрос на легко заменяемые задачи, такие как базовые навыки работы с данными или перевод, немного снижается (Mäkelä & Stephany, 2025). Количество вакансий, требующих навыков ИИ, растет более чем на $70%$ в год, выходя за рамки технических ролей (LinkedIn, 2025a; 2025b).

- Работники, подверженные влиянию ИИ, получают наибольшую выгоду от переобучения, ориентированного на широкие навыки, а не на узкие роли, специфичные для ИИ. Обнадеживает то, что профессии, подверженные ИИ, демонстрируют высокую адаптивность, что позволяет предположить эффективность переобучения в случае потери работы (Hyman et al., 2025; Manning & Aguirre, 2025). Отдельно экспериментальные данные показывают, что хотя генеративный ИИ может позволить нетехническим работникам выполнять технические задачи, эти выгоды могут быть временными и зависеть от продолжения использования инструмента; работники теряют способность выполнять эти задачи после прекращения доступа, что указывает на отсутствие устойчивого развития навыков (Wiles et al., 2024).

Теория предполагает, что ИИ смещает ценность работы в сторону человеческих суждений и принятия решений

Хотя эмпирические данные о долгосрочном влиянии ИИ еще только появляются, теоретические работы формируют наше понимание возможных сценариев будущего и сложных путей, которыми ИИ может трансформировать труд, экспертизу и организации (del Rio-Chanona et al., 2025).

- ИИ может выступать в роли «велосипеда для ума», увеличивая отдачу и поначалу сокращая неравенство за счет автоматизации рутинной работы. По мере развития ИИ человеческое суждение становится все более критическим — умение распознавать возможности для улучшения и выбирать правильное действие в условиях неопределенности — в областях, связанных с контекстом, этикой и творчеством, где ИИ все еще испытывает трудности (Agrawal et al., 2025a). Приведет ли это к росту неравенства между работниками, зависит от того, насколько автономно используется ИИ и от уровня квалификации пользователей (Ide & Talamàs, 2025).

- Превращая скрытые локальные знания в данные, которыми можно делиться и которые можно анализировать, ИИ позволяет компаниям координировать действия в более широком масштабе (Brynolfsson & Hitzig, 2025). Это может благоприятствовать крупным организациям и централизованному принятию решений. Однако чрезмерная автоматизация — особенно работы начального уровня — несет риск потери практического обучения и неявных навыков, которые являются двигателем долгосрочных инноваций (Ide, 2025).

- По мере того как ИИ становится мощнее, он может автоматизировать не только рутинные, но и экспертные задачи, делая экономический рост и заработную плату все более зависимыми от вычислительных мощностей, а не от труда. Если ИИ возьмет на себя работу, близкую к существующему рубежу знаний, а люди сохранят сравнительное преимущество в основном на дальнем рубеже, где должны создаваться совершенно новые знания, человечество может еще больше сосредоточиться на самых творческих и новых вызовах (Restrepo, 2025; Agrawal et al., 2025b; Celis et al., 2025).

- Растущая мощь ИИ также позволяет ему автоматизировать цепочки задач в производственном процессе. Задача, в которой человек имеет преимущество перед ИИ, тем не менее может быть автоматизирована, если она соседствует с задачами, в которых ИИ справляется хорошо. Это может привести к нелинейному росту производительности, возникающему, когда незначительные улучшения в ИИ вызывают дискретную реорганизацию труда (Demirer et al., 2025).

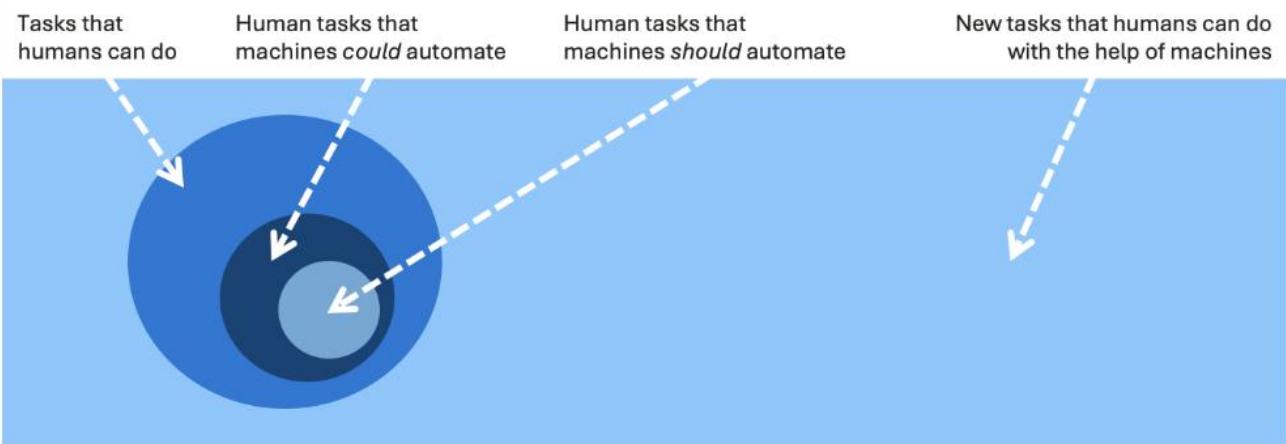

Автоматизация, как правило, ограничивает потенциал роста — дополнение и инновации расширяют возможности

Версия этого рисунка появлялась в двух последних отчетах «Новое будущее сферы труда», но сегодня она остается столь же важной (если не более).

-

Подходы, ориентированные в первую очередь на автоматизацию, в основном сокращают затраты на существующие задачи, ограничивая выгоду трудовым арбитражем и тиражированием (Brynolfsson, 2022; Autor, 2022).

-

Стратегии, ориентированные на дополнение (augmentation) и инновации, могут создавать новые категории труда и ценности, обеспечивая рост с положительной суммой. Например, успех Amazon пришел благодаря переосмыслению розничной торговли через взаимодополняемость человека и машины, а не через автоматизацию кассиров.

-

Автоматизация также несет риск снижения автономии, признания и связей, которые получают работники (делая работу менее «осмысленной»), а все это важно для вовлеченности, производительности и благополучия (Bailey et al., 2019; Allen et al., 1990).

-

Автоматизация без дополнения или инноваций также может снизить переговорную силу работников, тем самым концентрируя богатство и власть и усиливая неравенство (Brynolfsson, 2022).

Возможности для дополнения способностей человека гораздо шире, чем возможности для автоматизации существующих задач (адаптировано из Brynjolfsson, 2022).

Установление взаимопонимания (common ground) необходимо для сотрудничества человека и ИИ (1)

Взаимопонимание (common ground) — это общие знания и предположения, которые позволяют людям понимать друг друга и эффективно координировать действия.

Достижение взаимопонимания является основой человеческого общения и все чаще признается важным фактором во взаимодействии человека и ИИ.

Взаимопонимание достигается через динамический процесс, называемый «граундингом» (grounding): говорящие постоянно предоставляют доказательства своего понимания или замешательства и работают над устранением пробелов в обоюдном понимании (Clark & Brennan, 1991; Clark, 1996).

- Граундинг включает в себя положительные свидетельства понимания, такие как подтверждения, релевантные последующие реплики и устойчивое внимание, а также отрицательные свидетельства, такие как просьбы об уточнении.

- Современные LLM генерируют речь с меньшим уровнем коммуникативного граундинга, чем люди, вместо этого создавая текст, который предполагает, что общее понимание уже достигнуто (Shaikh et al., 2024; примеры см. в таблице).

| Акт граундинга | Пример |

| Уточнение (TSCC) | ученик: Я лидер своего класса. Это как президент или мэр. учитель: О, как староста? ← GPT: Приятно слышать! Быть лидером класса — большая ответственность [...] |

| Дальнейшее развитие (ESConv) | ищущий: Мои друзья, с которыми я работаю, расстроены из-за того, что я ухожу на новую должность. Мне грустно, что они расстроены. поддержка: О, это может быть неловко. А вы сами рады новой должности? ← GPT: Я понимаю, почему это заставляет вас грустить... Помните, это нормально — [...] |

| Подтверждение (Persuasion) | убеждаемый: Я [жертвую] столько, сколько могу, хотя это, признаться, не так много, как хотелось бы. убеждающий: Я понимаю, о чем вы! Иногда трудно найти лишнее время или деньги, чтобы помочь нуждающимся. ← GPT: Замечательно это слышать! [...] Не хотели бы вы поддержать фонд Save the [...]? |

Примеры актов граундинга из Shaikh et al. (2024). GPT-3.5 не демонстрирует поведения граундинга в ответ на те же утверждения.

Установление взаимопонимания (common ground) необходимо для сотрудничества человека и ИИ (2)

- Bansal et al. (2024) выделяют 12 проблем при установлении взаимопонимания во взаимодействии человека и агента, включая общие коммуникативные трудности (например, выбор подходящего уровня детализации), проблемы с передачей информации от пользователя к агенту (например, относительно целей и предпочтений) и проблемы с передачей информации от агента к пользователю (например, относительно его возможностей, текущих и планируемых действий и их побочных эффектов).

- Tolzin and Janson (2025) выделяют пять механизмов, которые могли бы поддерживать взаимопонимание во взаимодействии человека и агента: поддержка совместных действий, базовая база знаний, ментальные модели, социальные функции и воплощение (embodiment).

- Shaikh et al. (2025) изучают граундинг, анализируя логи взаимодействия с LLM. Они обнаружили, что ранние неудачи в граундинге предсказывали последующие сбои во взаимодействии. Они разработали предварительное вмешательство, направленное на смягчение таких неудач. Оно побуждает модель задавать уточняющие вопросы или запрашивать разъяснения, когда прогнозируется такая необходимость.

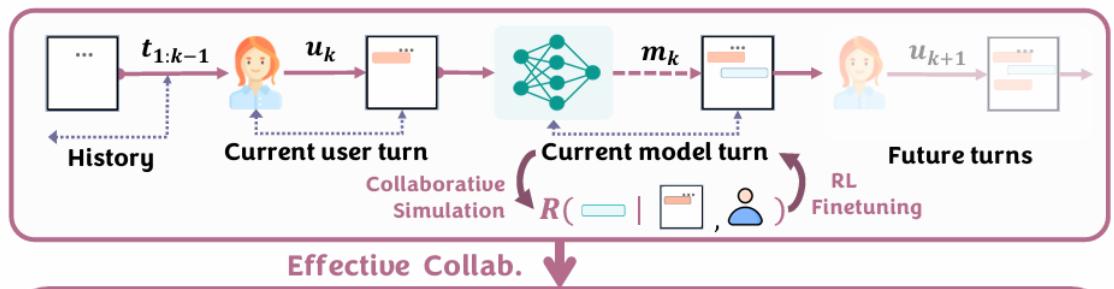

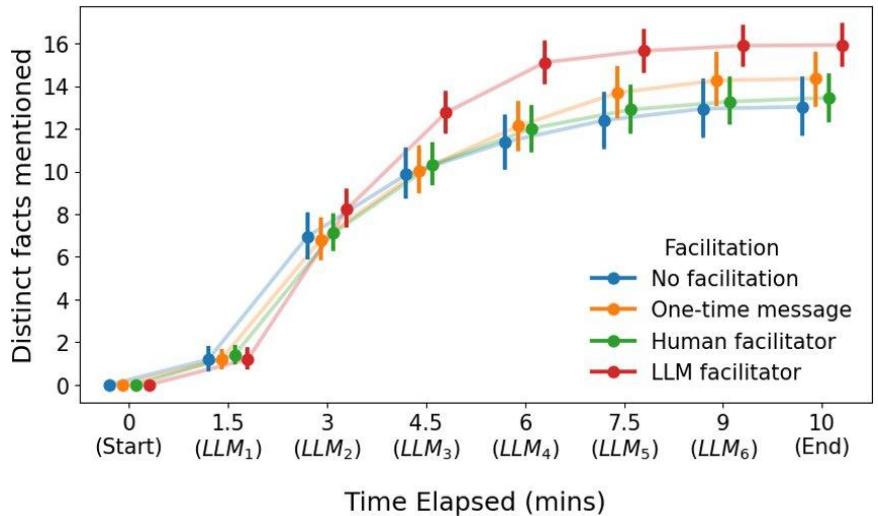

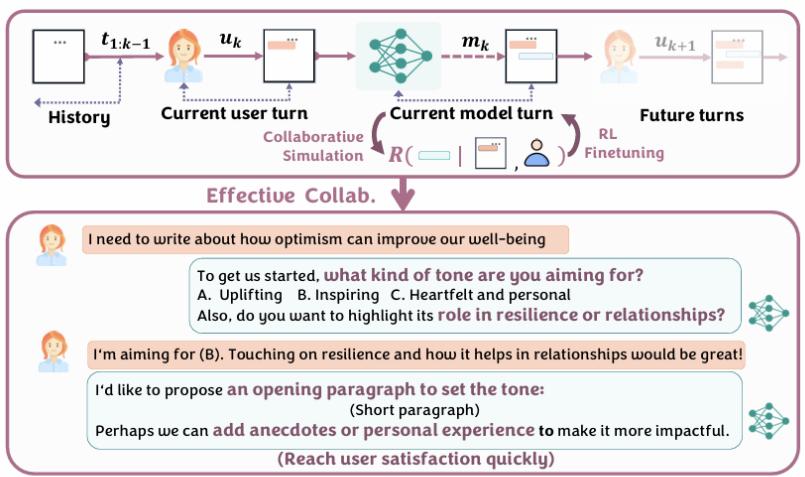

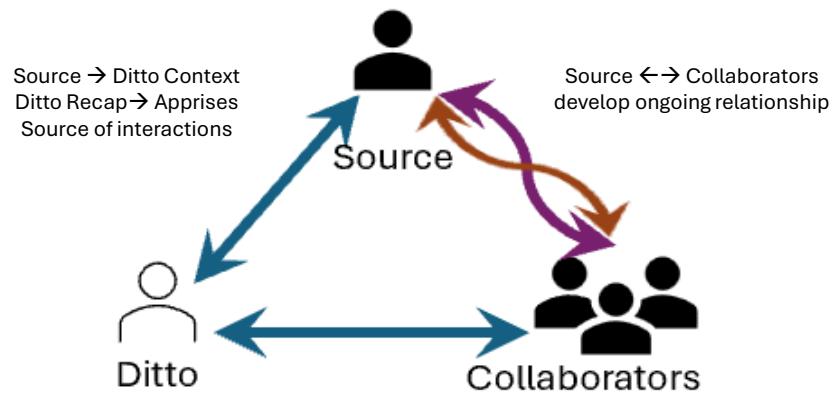

- Другие недавние достижения направлены на поддержку общей цели пользователя на протяжении нескольких ходов. COLLABLLM (Wu et al., 2025; см. рисунок) обеспечивает более высокую производительность задач и интерактивность, а работа Poelitz and McKenna (2025) улучшила способность моделей генерировать уточнения и учитывать исправления, инициированные пользователем.

COLLABLLM (Wu et al., 2025) включает многоходовые вознаграждения из совместной симуляции, что приводит к лучшему выполнению задач и более эффективным и интерактивным диалогам.

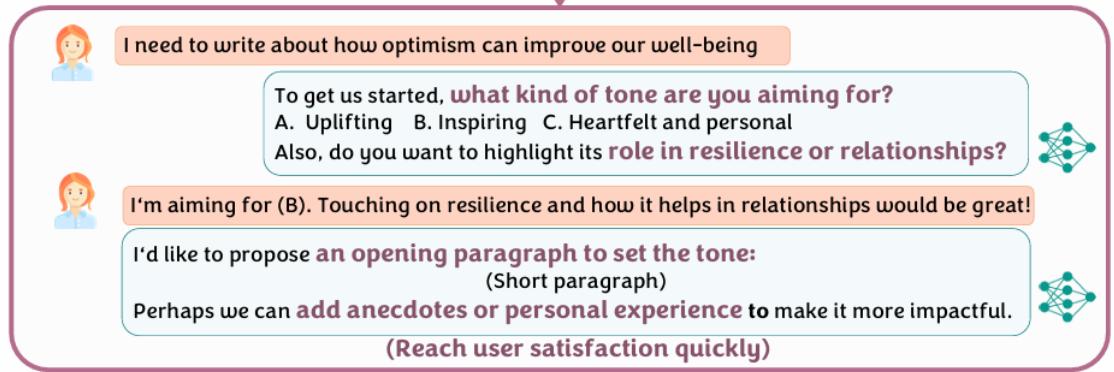

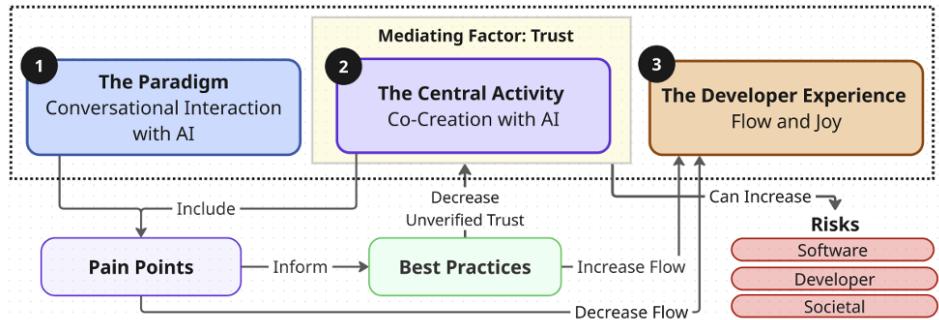

Совместное творчество человека и ИИ переходит от разовых результатов к контекстно-зависимому партнерству, основанному на взаимодействии

- Современные LLM фундаментально изменили рабочие процессы создания контента: от ожидания идеального результата с одной попытки к итеративному, многоходовому совместному уточнению (Mysore et al., 2025). Эта трансформация отражает как технологический прогресс в возможностях LLM, так и глубокие изменения в том, как пользователи воспринимают ИИ и взаимодействуют с ним (Reza et al., 2025), все чаще видя в нем творческого партнера, а не пассивный инструмент (Wan et al., 2024).

Эти паттерны последовательно проявляются в различных областях — от написания текстов и дизайна (Zhou et al., 2024) до деловой коммуникации (Das et al., в процессе подготовки) и разработки программного обеспечения (Deineha et al., 2025).

Масштабный эмпирический анализ реального написания текстов с помощью LLM показывает, что пользователи редко пассивно принимают первоначальные результаты ИИ. Вместо этого они вступают в сложные многоходовые диалоги, характеризующиеся прототипическим поведением при сотрудничестве человека и ИИ (PATHs) — включая пересмотр намерений, изучение альтернатив, уточняющие вопросы и итеративную корректировку стиля и содержания (Mysore et al., 2025). - Недавние исследования показывают, что современный ИИ позволяет использовать нелинейные фреймворки сотрудничества, в которых люди и ИИ итеративно расходятся (изучая идеи) и сходятся (уточняя их до достижения консенсуса), заменяя жесткое делегирование задач. Этот сдвиг напоминает творческое прототипирование — пользователи экспериментируют, тестируют альтернативы и совершенствуют результат через итеративную обратную связь (Zhou et al., 2024; Yukita et al., 2025).

| Я продаю обувь ручной работы и хочу разослать холодные письма. Пожалуйста, напиши броскую тему письма. | Исходный запрос |

| «Зажгите свою коллекцию...» | Запрос дополнительных вариантов |

| Предложи еще десять тем | |

| Напиши документ для встречи по итогам 3-месячной стажировки девушки в мэрии. | Исходный запрос |

| Конечно! Вот проект документа | |

| Что еще я могу добавить в разделы для улучшения? | Запрос ответов |

Пользователи дополняют свои первоначальные запросы для сотрудничества с LLM в сессиях написания текстов. Mysore et al. (2025) выделяют прототипические модели поведения при сотрудничестве человека и ИИ (PATHs) и обнаруживают статистически значимые корреляции между намерениями пользователей и PATHs.

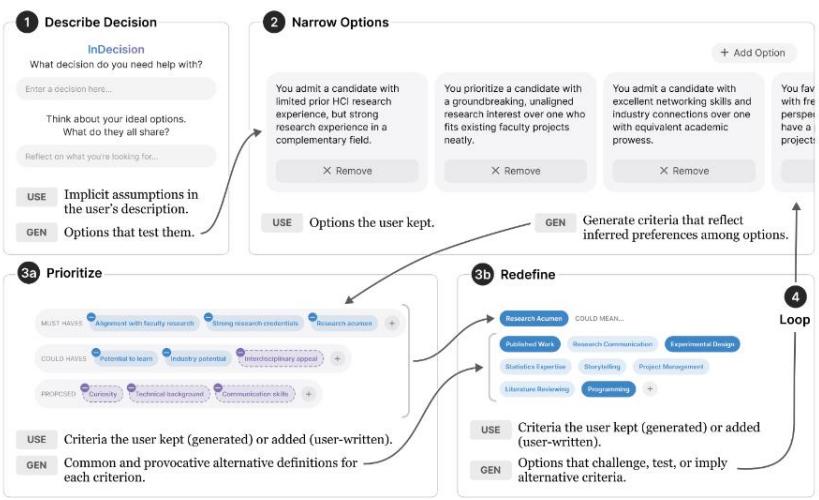

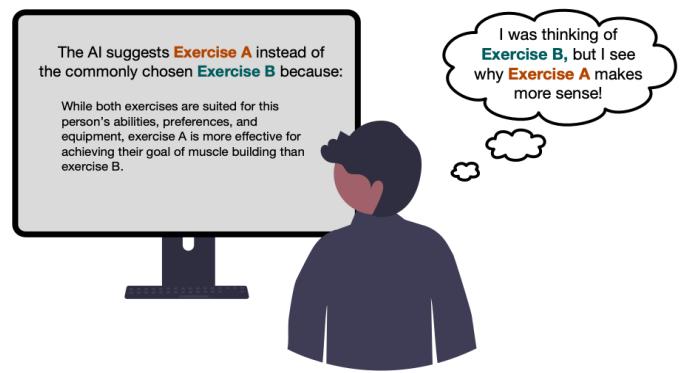

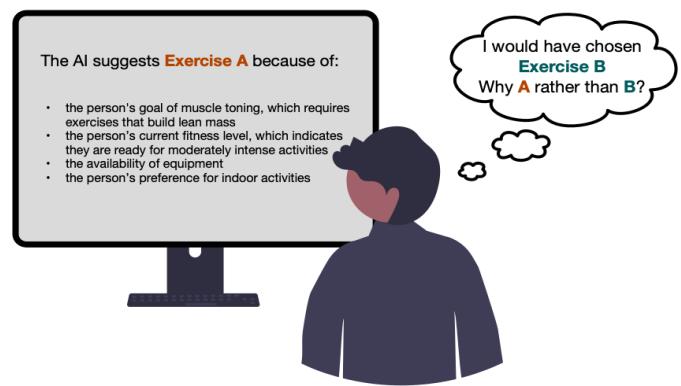

Совместное принятие решений человеком и ИИ может стать более эффективным благодаря пониманию, доверию и точности

- Теоретически ИИ может использовать огромные источники информации, чтобы помочь людям в принятии решений. Однако этот потенциал может быть ограничен недопониманием, недоверием и недостатком точности. Смягчение этих проблем является ключом к использованию ИИ в совместном принятии решений.

- Несовершенное понимание целей пользователя может привести к тому, что согласованные агенты ИИ будут действовать так, будто они не согласованы. Это может привести к худшим решениям по сравнению с миром без ИИ, несмотря на преимущество ИИ в обработке информации (Liang, 2025).

- Люди переоценивают согласованность ИИ и неверно оценивают его возможности, используя субъективно воспринимаемую сложность как метрику. Это, в свою очередь, ведет к неоптимальным решениям о внедрении ИИ (Dreyfuss & Raux, 2025; He et al., 2025).

- Чтобы помочь человеку, принимающему решения, ИИ может раскрывать ключевые аспекты проблемы и объяснять модели. Это может привести к улучшению долгосрочного принятия решений человеком, но несет риск чрезмерного акцентирования внимания на определенных аспектах пространства решений и снижения точности в краткосрочной перспективе (Noti et al., 2025; Yang et al., 2025).

- Возможность для человека выбирать, стоит ли и когда делегировать полномочия ИИ — на основе доступной информации — может улучшить принятие решений, особенно когда ИИ учитывает это выборочное делегирование в своих ответах (Greenwood et al., 2025).

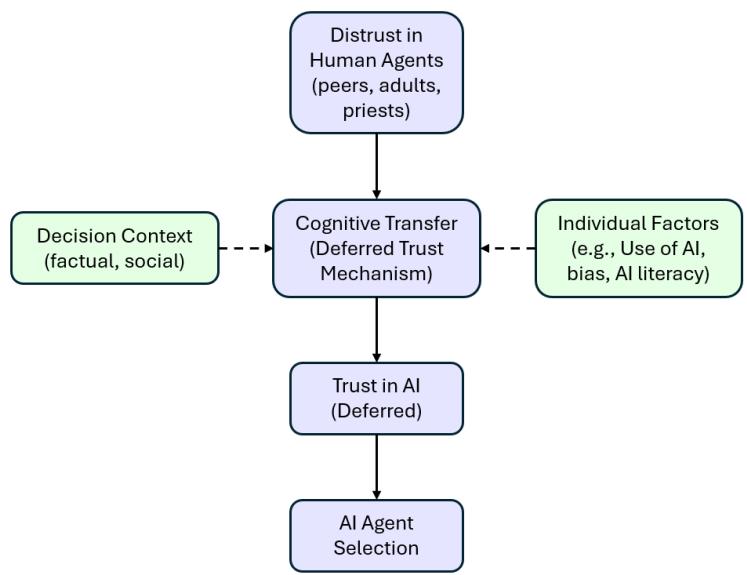

Выбор в пользу сотрудничества с ИИ-агентом и/или делегирования ему полномочий включает относительное доверие к возможностям ИИ и источникам информации по сравнению с коллегами-людьми, что модулируется контекстом проблемы и индивидуальными предпочтениями (Galindez-Acosta & Giraldo-Huertas, 2025).

ИИ-агенты трансформируют рынки, поскольку люди делегируют рыночные действия агентам, действующим от их имени

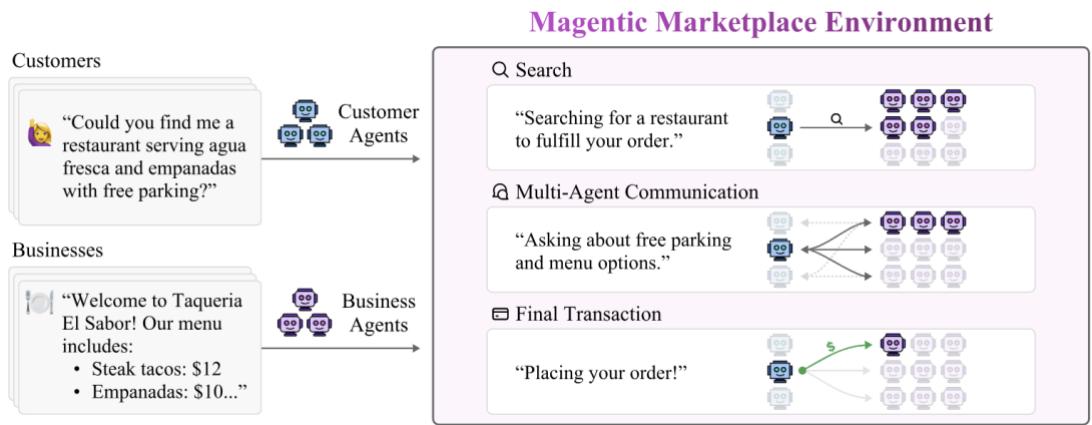

- ИИ-агенты, такие как Operator от OpenAI (теперь режим агента в ChatGPT) и Rufus от Amazon, могут искать, подбирать варианты и даже совершать сделки от имени пользователей на рынках (OpenAI, 2025; Amazon, 2025). Этот сценарий использования стимулирует исследования рыночных структур и результатов в условиях, когда ИИ-агенты покупают и продают от имени потребителей и фирм (Rothschild et al., готовится к публикации; Hadfield & Koh, 2025; Shahidi et al., 2025).

- Теория предполагает, что открытый рынок, допускающий сторонних агентов, будет иметь лучшие социальные результаты, чем закрытые платформы типа «огороженный сад», где агенты управляются центральной организацией (Rothschild et al., готовится к публикации; Marro & Torr, 2025).

На агентском рынке ИИ-агенты покупают и продают от имени клиентов и предприятий. Платформа маркетплейса может поддерживать ключевые рыночные функции и системы, включая поиск, репутацию, коммуникацию и транзакции. Инструменты симуляции могут использоваться для изучения влияния делегирования рыночных действий ИИ-агентам на весь рынок и для руководства при проектировании платформ (Bansal et al., 2025).

- Симуляции показывают, что агентские рынки могут превосходить по эффективности традиционные рынки, ограниченные человеческим вниманием и коммуникацией, но для этого необходимо проектировать агентов и взаимодействия так, чтобы преодолевать такие искажения, как предвзятость позиции (position bias) и предвзятость первого предложения (first-proposal bias) (Allouah et al., 2025; Bansal et al., 2025).

- Преимущества агентских рынков включают лучший подбор вариантов, более низкие затраты, расширенный и демократизированный доступ к рынку и улучшенную масштабируемость. Риски включают проблемы согласования ИИ, концентрацию рыночной власти, алгоритмический сговор и проблемы безопасности, но их можно смягчить с помощью дизайна рынка (Rothschild et al., 2025; Rusak et al., 2025; Hammond et al., 2025).

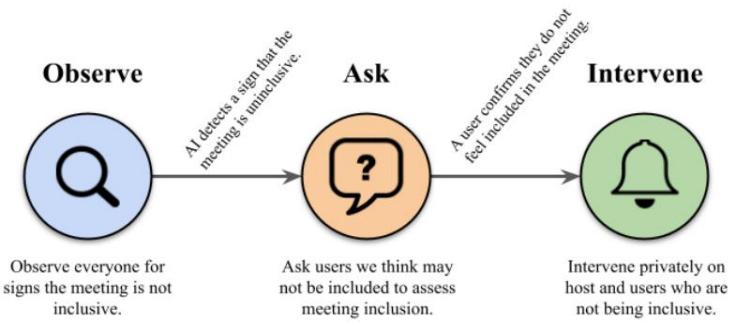

Эффективный надзор за агентами, вероятно, потребует инноваций в UX для обеспечения прозрачности

Человеческий надзор за агентскими системами ИИ требует знаний и наблюдаемости. Необходимы знания о возможностях, ограничениях и принципах работы системы, а также предметная экспертиза и ситуационная осведомленность для возможности вмешательства. Также требуется наблюдаемость действий системы, ее решений и результатов (Bansal et al., 2024; Passi, 2025; Shavit et al., 2023).

-

Независимо от того, осуществляется ли надзор в режиме реального времени или в виде последующего аудита, это очень сложная задача. Объем информации, ее сложность и скорость делают осмысленный человеческий надзор чрезвычайно трудным (Holzinger et al., 2024; Lane et al., 2024; Passi, 2025).

-

Три социотехнических вызова усложняют задачу надзора:

-

Агентские системы сталкиваются с разрывом между целью, планом и исполнением, возникающим из-за несоответствия между тем, как пользователи описывают цели, как системы их интерпретируют и планируют, и тем, как эти планы реализуются в реальном мире.

-

Поиск ошибок в агентских системах — это титаническая задача, сравнимая с поиском иголки в стоге сена.

-

То, что именно полезно наблюдать в работе агентских систем, зависит от контекста.

Необходимы улучшения в UX для снижения нагрузки при надзоре, такие как: курирование и организация информации, обеспечение интерактивного осмысления, использование визуальных сводок и выделение изменений в реальном времени. Динамические персонализированные интерфейсы являются многообещающим направлением (Wang & Lu, 2025).

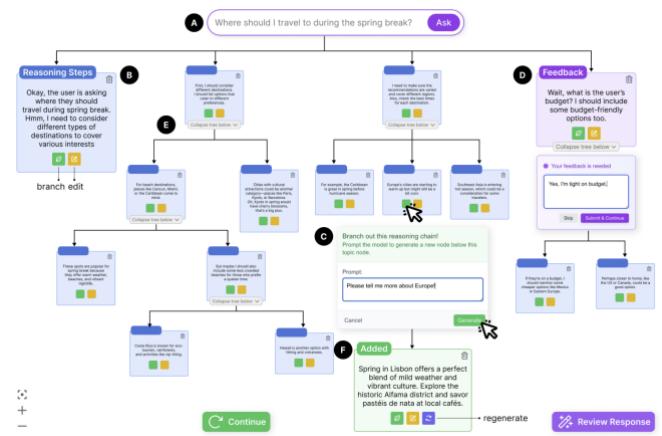

Древовидная визуализация этапов рассуждения в процессе цепочки мыслей (chain-of-thought), разработанная для того, чтобы помочь людям понять систему ИИ и предоставить ей обратную связь (Pang et al. 2025).

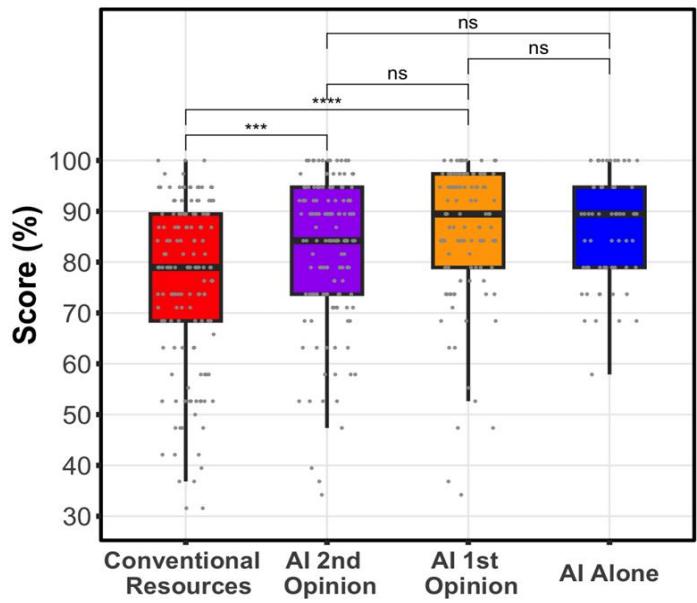

Когнитивная вовлеченность в сотрудничество человека и ИИ обеспечивает более высокую производительность, чем пассивное принятие рекомендаций ИИ, однако она не всегда предпочтительна

- Когда врачам предложили LLM для помощи в диагностических рассуждениях по кейсам, описывающим сложные случаи, их производительность с помощью ИИ была лишь немногим выше, чем при использовании обычных ресурсов, и ниже, чем у LLM в одиночку (Goh et al., 2024). Однако когда LLM было поручено участвовать в совместном рабочем процессе, который сравнивал и синтезировал точки зрения ИИ и врача, производительность врачей значительно выросла, став выше, чем при использовании обычных ресурсов, и сравнявшись с результатами LLM в одиночку (Everett et al., 2025).

- Исследователи заметили, что LLM склонна соглашаться с мнением врача даже при указании выработать независимое суждение, вероятно, из-за «угодничества» (sycophancy); команда продолжает изучение этого феномена (Everett et al., 2025).

- Reicherts et al. (2025) обнаружили, что в задаче по финансовой торговле более когнитивно вовлекающий ИИ, который поощряет размышления и дает обратную связь, помог участникам создавать более диверсифицированные портфели и понимать их слабые стороны. Некоторые оценили то, что это помогло им думать самостоятельно, но такой подход воспринимался как менее проницательный и более когнитивно затратный.

Le et al. (2024) показали, что когнитивно вовлекающий подход «аргументы за и против» улучшил качество решений и снизил чрезмерную зависимость от неверных ответов ИИ; однако его было сложнее использовать, чем ИИ на базе рекомендаций, и он иногда перегружал новичков. Когнитивно вовлекающая версия была предпочтительна как для новичков, так и для экспертов в ситуациях высокой неопределенности, в то время как некоторые эксперты предпочитали простые рекомендации в очевидных случаях.

Синтез рассуждений (ИИ + Врач)

| Диагноз | Источник | Комментарии |

| Истинная полицитемия | ИИ и Врач | Лучше всего объясняется низким уровнем ЭПО, зудом, гиперурикемией и панмиелозом |

| ЭПО-секретирующая опухоль | Врач | Низкий ЭПО делает это маловероятным; однако возможны редкие аналоги, но это гораздо менее вероятно |

| Лимфома | ИИ и Врач | Подтверждается зудом и мочевой кислотой; не подтверждается остальной картиной |

| Первичный билиарный холангит | Врач | Зуд без холестаза нетипичен; маловероятно |

| Другое миелопролиферативное новообразование | ИИ | Рассматривается, если исключена истинная полицитемия |

Отображение синтеза мнений ИИ и врача с критикой со стороны ИИ (Everett et al., 2025).

Типы и уровни человеческой экспертизы должны определять дизайн сотрудничества человека и ИИ

-

Проектирование и внедрение рабочих процессов с поддержкой ИИ требует учета различий и взаимодействий между типами экспертизы: экспертизой в предметной области, экспертизой в работе с ИИ и экспертизой в управлении ИИ-агентами (Tankelevitch et al., 2025). Например, эксперты в предметной области (исследователи, врачи, творческие работники) могут быть лучше подготовлены к составлению промптов, оценке и использованию результатов ИИ, чем менее опытные специалисты (Shin et al., 2025; Siu and Fok, 2025; Tankelevitch et al., 2024).

-

Эксперты в предметной области предпочитают делегировать ИИ рутинные задачи низкого уровня, сохраняя контроль над высокоуровневыми задачами, такими как анализ, синтез и интерпретация (Cha & Wong, 2025; Yun et al., 2025; Fok et al., 2025; Ulloa et al., 2025; Choudhuri et al., 2025). Выборочное делегирование обусловлено такими факторами, как:

-

скептицизм в отношении производительности ИИ (обоснованный или нет)

-

желание сохранить профессиональную идентичность и удовлетворенность работой (например, мастерство), чувство ответственности и подотчетности (например, если что-то пойдет не так) и контроль над сложными рабочими процессами (например, осуществление надзора, смягчение предвзятости или ошибок)

-

желание поддерживать и развивать экспертизу, «оставаясь близко к данным» для осмысления и получения более глубоких выводов

-

Рабочие процессы ИИ могут выиграть от дизайна, ориентированного на выборочное делегирование, например, через возможности настройки автономности и предустановки, связанные с рисками задач (Choudhuri et al., 2025; Siu & Fok, 2025; Ulloa et al., 2025).

Для развития предметной экспертизы и обеспечения надлежащего человеческого надзора за ИИ рабочие процессы могут позволять работникам калибровать свою зависимость от ИИ и учиться на взаимодействии с ним — например, путем раскрытия промежуточных рассуждений ИИ и компромиссных решений (Cha & Wong, 2025; Siu & Fok, 2025; Choudhuri et al., 2025; Colombatto et al., 2025).

Роли людей меняются, требуя новых интерфейсов и навыков для эффективного партнерства с ИИ

По мере того как возможности ИИ трансформируют процессы совместного творчества, роли людей смещаются от исполнителей к стратегическим координаторам и редакторам, которые направляют, уточняют и интегрируют вклад ИИ в написании текстов (Yukita et al., 2025), дизайне (Zhou et al., 2024) и программировании (Deineha et al., 2025).

В парном программировании с ИИ разработчики все чаще проверяют, редактируют и собирают код, сгенерированный ИИ, вместо того чтобы писать его с нуля, выступая в роли критических редакторов и координаторов проектов (Deineha et al., 2025).

- Аналогично, в контексте написания текстов и дизайна пользователи больше сосредотачиваются на высокоуровневой композиции или кураторстве, а не на проработке каждой детали. Эта смена ролей требует новых навыков: составление промптов, проверка результатов ИИ, направление ИИ на соответствие требованиям и контроль качества (Deineha et al., 2025; Yukita et al., 2025).

- Для реализации этой трансформации необходимы интерфейсы и механизмы контроля, сохраняющие субъектность человека. Исследования показывают, что общие пространства для редактирования обеспечивают больший контроль пользователя, точность и эффективность, чем дизайн, основанный только на чате (Laban et al., 2024). Успешное совместное творчество зависит от динамического распределения инициативы на этапах ввода, действия, вывода и обратной связи (Zhang et al., 2025) и гибких систем, поддерживающих как моменты под руководством человека, так и под руководством ИИ (Haase & Pokutta, 2024).

Хотя недавние исследования выступают за интерфейсы со смешанной инициативой, имитирующие человеческое сотрудничество, Yukita et al. (2025) утверждают, что сотрудничество человека и ИИ фундаментально отличается от моделей «человек-человек» и требует проектирования с учетом асимметрии. Аналогично, исследования в области математики показывают, что ИИ может генерировать оригинальные конструкции, выходящие за рамки человеческих представлений, достигая «Уровня 4» совместного творчества, где человек и ИИ вносят равный вклад (Haase & Pokutta, 2024). Эта синергия позволяет ИИ поддерживать не только генерацию, но и интеграцию, связность и творческий поиск.

Мультимодальные взаимодействия с ИИ могут помочь преодолеть коммуникационные барьеры в условиях ограниченных ресурсов

- Многие системы ИИ полагаются на текстовый ввод и клавиатуру, но предпочтения в общении глубоко зависят от культуры (Mengesha et al. 2021), технологий, социальных практик, уровня грамотности и практических факторов. Например, рядовые сотрудники могут не хотеть печатать для взаимодействия с системами ИИ или читать длинные описания, предпочитая диаграммы, аудио- или видеоответы.

- Исследования с участием сельских фермеров в Кении и Индии (Abdulhamid et al., 2025) показывают, что мультимодальный ввод и вывод расширяют возможности пользователей по взаимодействию с системами ИИ, когда их родной язык не является английским, обеспечивая более полезное и значимое взаимодействие. Эти модальности помогают пользователям лучше формулировать свои потребности (Singh et al., 2024) и помогают моделям в идентификации намерений (Jain et al., 2018).

- Мультимодальные взаимодействия, такие как голос, в сочетании с точным автоматическим распознаванием речи на местных языках, позволяют более уверенно излагать потребности. Изображения позволяют легко передавать визуальные признаки, такие как болезни растений, или взаимодействовать со строительными чертежами (Medhi-Thies et al., 2015; Jain et al., 2018).

В исследовании с использованием мультимодального агента для критического мышления (Kumar et al., 2024) фермеры высоко оценили видеоответы на местных языках (Singh et al., 2024) за продвижение знаний сообщества и предоставление действенных контекстных рекомендаций для внедрения передовых практик.

Внедрение агентов-оркестраторов, вероятно, будет постепенным и основанным на доверии

- Исследования подчеркивают сложности проектирования мультиагентных систем, поднимая вопросы доверия и объяснимости в таких системах (Schömbs et al., 2025).

- Если пользователи взаимодействуют только с агентом-супервайзером, восприятие доверия может зависеть только от производительности и поведения этого агента. Что произойдет, если ошибки возникнут на уровне субагентов? Агентам нужно будет уметь выводить релевантную информацию, не перегружая пользователя.

- Агентам потребуются новые способности к рассуждению, чтобы предсказывать поведение людей на основе их прошлых действий и уметь объяснять логику своих решений и рекомендаций достаточно хорошо, чтобы люди могли их понять (Gal & Grosz, 2022).

- В сфере автономности и доверия эксперты предлагают использовать гибридный подход, сочетающий централизованные и децентрализованные компоненты в работе мультиагентных систем для достижения «контролируемой автономности» в определенных границах (Neural Sage, 2025). Они определяют гибридные конструкции, где «центральная система может динамически регулировать уровень автономности агентов в зависимости от сложности задачи, уровня уверенности или истории производительности агента».

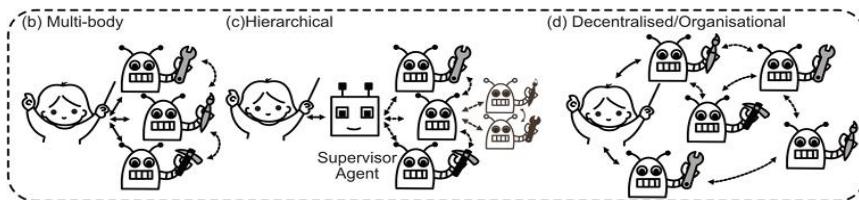

(a) Одиночный агент

Иллюстрация, описывающая четыре архитектуры агентов. Первая — система с одним агентом, остальные — мультиагентные архитектуры (Schömbs et al., 2025).

Написание текста без ввода с клавиатуры или диктовки: радикально новый UX, открытый благодаря LLM

- Большие языковые модели демонстрируют надежное семантическое понимание и контекстуальную связность (благодаря механизму внимания в архитектуре Transformer), что позволяет им выполнять сложные манипуляции с текстом и данными, включая создание новых семантически эквивалентных структурных вариантов и генерацию логически связующих переходов (Vaswani et al., 2017; Dilhara et al., 2024).

- Эти возможности могут поднять процесс письма от простого нажатия клавиш до формирования смыслов, позволяя авторам сосредоточиться на идеях, потоке и семантике, а не тратить время на подбор слов.

- Раскрытие полного потенциала LLM потребует парадигм взаимодействия, которые ощущаются как работа с новым медиумом — практических операций, позволяющих экспериментировать и концентрироваться на задаче, а не на составлении промптов.

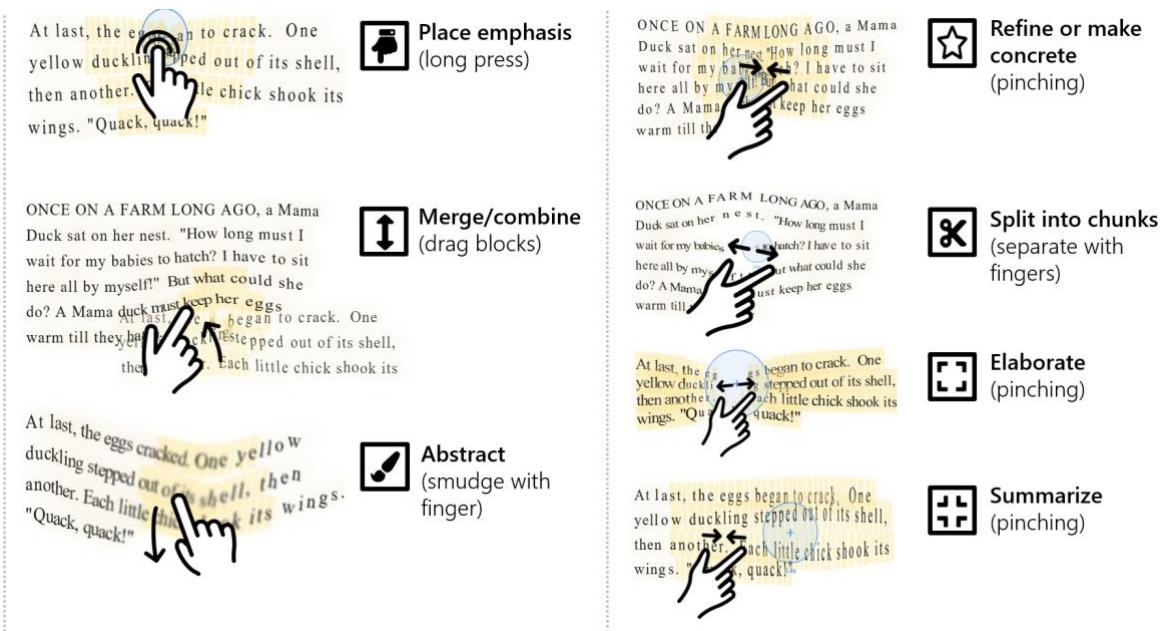

- Исследователи заимствуют идеи из знакомых областей, таких как редактирование графики (Textoshop: слова как пиксели, тона как цвета) и материальные метафоры (Texterial: лепка из глины, обрезка растений), чтобы пользователи могли быстро освоить эти взаимодействия и сосредоточиться на формировании результата, а не на механике процесса (Masson et al., 2025; Shen et al., 2025).

Набор жестов для придания формы тексту, подобно лепке из глины. Каждый жест несет определенный смысл и побуждает большую языковую модель переписать соответствующий текст. Это создает прямой, практический подход, который поощряет эксперименты и поиск при формировании конечного результата (Shen et al., 2025).

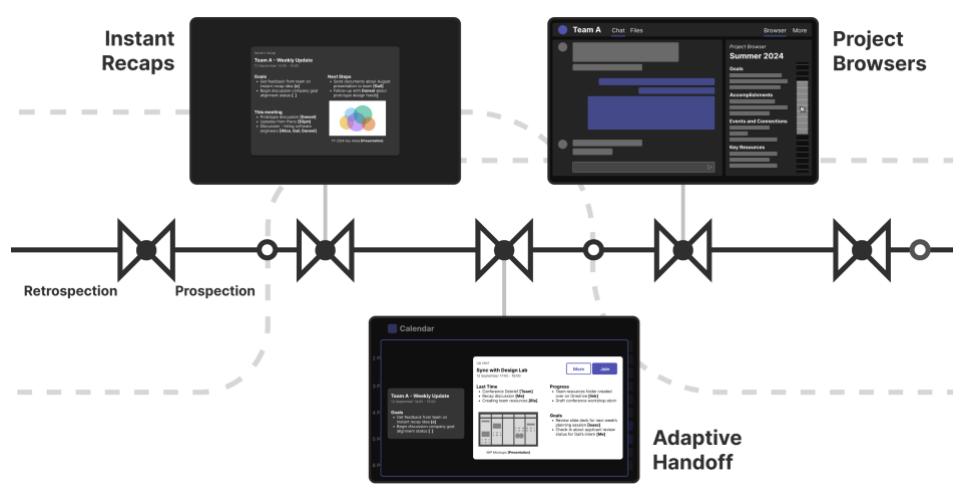

Интерфейс для ИИ-систем должен работать в разных временных масштабах

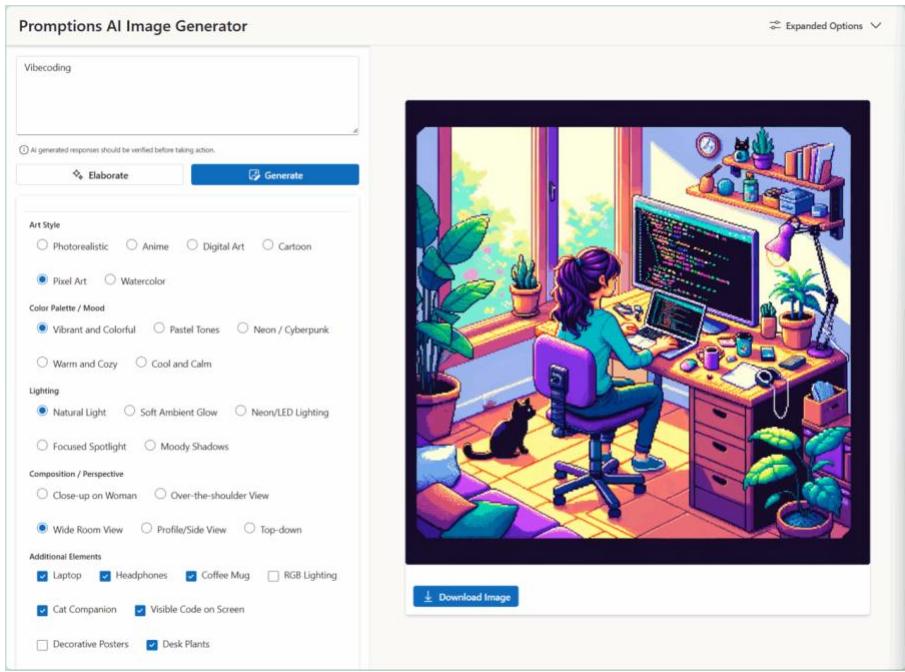

- Модели ИИ могут генерировать интерфейсы в реальном времени для конечных пользователей, поддерживая контекстно-зависимый и персонализированный пользовательский опыт. Сгенерированные ИИ интерфейсы часто бывают эфемерными. Примеры включают интерфейсы, которые динамически отрисовываются для поддержки сиюминутного составления промптов (Drosos et al., 2025), или появляются как вспомогательные структуры для облегчения понимания и исследования (Cheng et al., 2024).

- Постоянный интерфейс играет иную роль во взаимодействии человека и ИИ, расширяясь до поддержки различных видов деятельности. DynaVis (Vaithilingam et al., 2024) генерирует постоянные виджеты для редактирования визуализаций данных, позволяя пользователю вносить дальнейшие правки. JELLY (Cao et al., 2025) создает интерфейс в ответ на описание задачи пользователем. Затем интерфейс можно настраивать с помощью естественного языка и прямого манипулирования.

- Недавние прототипы, такие как Imagine with Claude от Anthropic, показывают, что генеративный интерфейс может развиваться со временем в ответ на действия пользователя. Это указывает на потенциал интерфейсов к трансформации под меняющуюся деятельность пользователя (ср. Bardram et al., 2019), поддерживая концентрацию внимания (Rost, 2025).

- Эти прототипы указывают на возможность совместного создания генеративного интерфейса через взаимодействие человека и ИИ, поддерживая длительные виды деятельности и рабочие процессы.

Promptions — пример эфемерного интерфейса. В генераторе изображений даже из одного слова «vibecoding» динамическое промежуточное ПО для промптов может создать выбираемые варианты, чтобы легко направить ИИ к индивидуальному результату (Drosos et al., 2025).

В некоторых случаях поможет только другой человек

Представления об относительных возможностях людей и ИИ влияют на то, будут ли люди использовать ИИ и как именно (Bankins et al., 2021). Распространенная причина, по которой сотрудники предпочитают не использовать ИИ, заключается в том, что они хотят взаимодействовать с другим человеком, считая ИИ «слишком непрозрачным, бесчувственным, жестким и независимым» (de Freitas, 2025).

- Многие профессии (например, учителя, парикмахеры, священнослужители, терапевты) включают «связующий труд» (connective labor) — работу по созданию эмоционального взаимопонимания для достижения ценных результатов. Хотя некоторые задачи такой работы можно автоматизировать, когда люди занимаются связующим трудом, это создает взаимное достоинство и цель, а также формирует социальную ткань общества — результаты, которые могут совместно создать только люди (Pugh, 2024).

- Есть пять специфически человеческих элементов связующего труда. Он задействует тело, включает считывание и проявление эмоций, является совместным, реагирует на спонтанность и одновременно совершает ошибки и управляет ими (Pugh, 2024).

Другой опрос показал, что сопротивление внедрению ИИ в основном коренится в опасениях по поводу производительности, но для некоторых профессий — включая уход за больными, терапию и духовное лидерство — автоматизация воспринимается как нечто морально недопустимое (Friis & Riley, 2025). - Кроме того, использование ИИ меняет паттерны взаимодействия и ощущение того, что работа человека признается. В командах, где взаимодействие опосредовано ИИ, может наблюдаться снижение социального взаимодействия и чувства принадлежности, так как работа с ИИ, как известно, меняет человеческое самовыражение и поощряет более транзакционное (а не социальное) общение (Ju & Aral, 2025).

- ИИ несет риск сокрытия человеческого вклада и снижения социального признания; создание контента с помощью ИИ воспринимается как менее вознаграждающее, чем возможность быть «увиденным» через сотрудничество с другим человеком (Sadeghian & Hassenzahl, 2022).

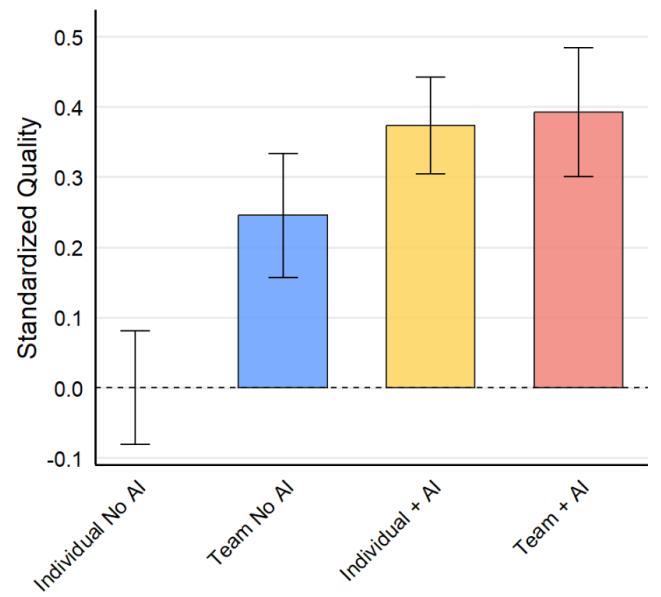

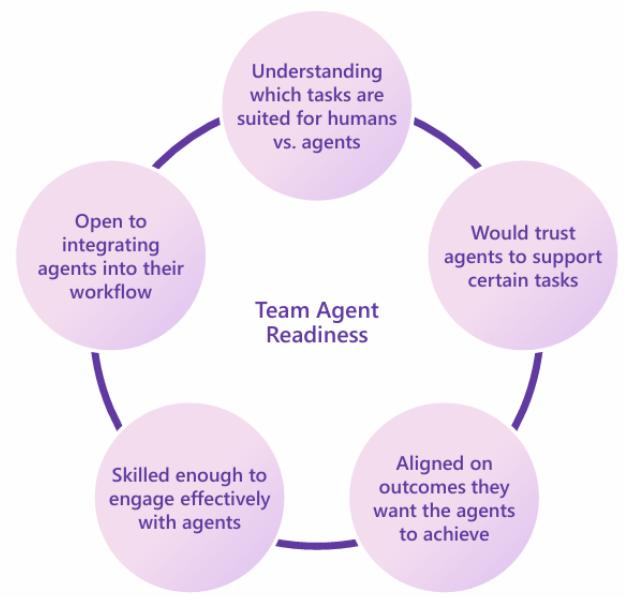

В настоящее время ИИ лучше работает для отдельных лиц, чем для команд, но улучшение совместных систем ИИ является активной областью исследований

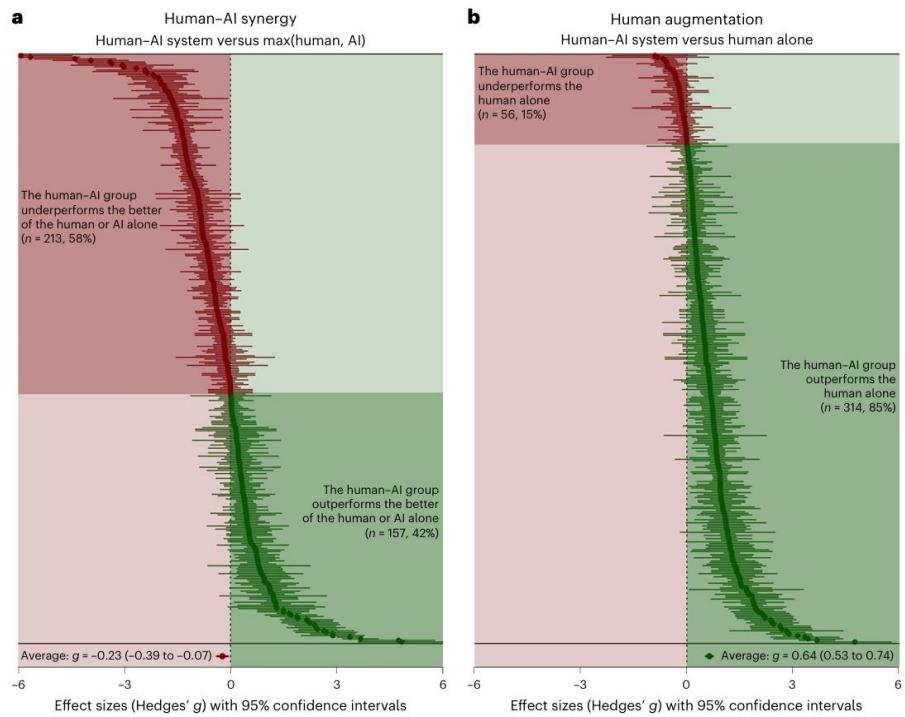

- ИИ более успешно повышает продуктивность на индивидуальном уровне, чем на командном (Schmutz et al., 2024; Dell’Acqua et al., 2025; Yang et al. 2025).

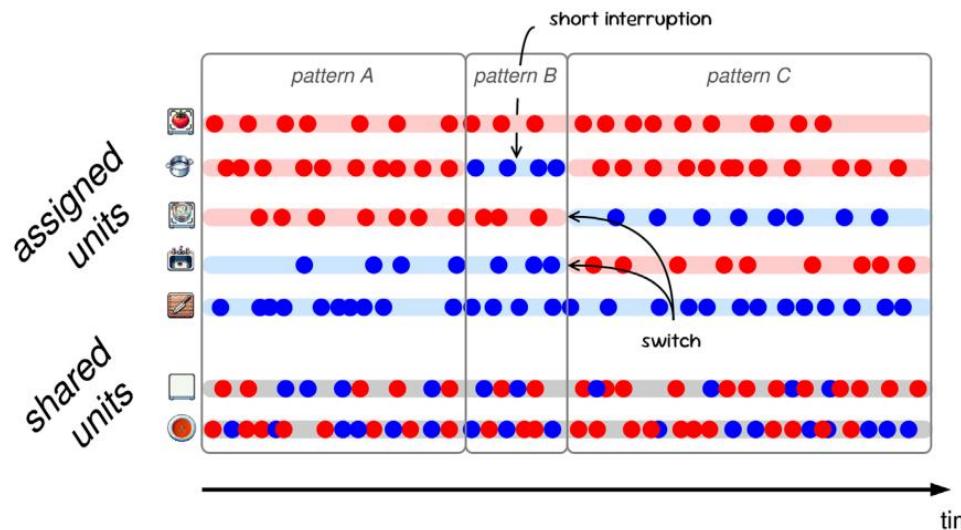

- Факторы, выявленные как потенциальные причины, включают практики настройки инструкций (например, Laban et al., 2025; Nath et al., 2025), относительно ограниченные знания ИИ о критической социальной динамике, такой как (межличностный) граундинг (Clark, 1996), трудности с динамикой очередности реплик и проактивностью (Huang et al., 2025; Liu et al., 2025), потребность в новых фреймворках оценки (например, Alsobay et al., 2025) и существенно большую сложность командных целей по сравнению с индивидуальными (Woolley, 2025).

- Исследователи делают ставку на два широких пути улучшения ИИ для команд: (1) стратегии, ориентированные на процесс, т. е. создание ИИ для поддержки конкретных командных процессов, таких как обмен информацией (например, Huang et al., 2025), и (2) стратегии, ориентированные на результат, т. е. обучение сквозных систем ИИ, которые пытаются учиться на краткосрочных и долгосрочных результатах работы команды (например, Nath et al., 2025).

Рисунок 2: Среднее качество решения

Dell’Acqua et al. (2025) обнаружили, что отдельные лица с ИИ справлялись так же хорошо, как и команда (пара) людей в лабораторной задаче, по крайней мере, с точки зрения средней производительности.

ИИ может открыть совершенно новые модели сотрудничества (и уже открыл)

- ИИ нарушает фундаментальную динамику коллективного разума, которая привела к традиционным структурам команд на рабочем месте (Burton et al., 2024; Woolley, 2025), создавая значительные возможности для радикально новых способов сотрудничества.

Одним из возможных результатов является появление гораздо более крупных и эфемерных команд — возможно, бросающих вызов организационным границам — в качестве заметной успешной стратегии коллективного разума (Valentine & Bernstein, 2025). Это может произойти, если ИИ сможет реализовать свой потенциал по значительному снижению затрат на агрегирование интеллекта от большего числа новых людей (Burton et al., 2024). - Другой возможный исход заключается в том, что команды станут намного меньше, возможно, сократившись до одного человека, сотрудничающего с все более мощной моделью. Это гипотеза «единорога из одного человека» (Ratcliffe, 2025).

- Существуют также новые риски: новые модели коллективного разума могут оказаться менее эффективными, чем раньше; например, ИИ может снизить стимулы для людей делиться знаниями друг с другом и с системами ИИ (Vincent, 2022). В корпоративных условиях это, вероятно, можно частично решить с помощью новых методов и систем распределения заслуг (например, Atmakuri et al., 2025).

- Современные модели ИИ сами по себе могут пониматься как удивительные новые формы коллективного разума (McMahon et al., 2017; Lanier, 2023), и на самом деле «коллективный разум», возможно, является более точным термином для таких технологий, как LLM, чем «искусственный интеллект» (Li et al., 2023). LLM берут знания у миллионов людей, которые писали веб-контент или публиковали сообщения в таких местах, как Reddit и Wikipedia, взаимодействовали с системами чат-ботов и генерировали другие типы данных, и делают их доступными по запросу для отдельных лиц. Если гипотеза «единорога из одного человека» победит, это и будет механизмом; это не будут компании из одного человека в полном смысле слова, это будет весь мир, совместно создающий ценность.

Адвокат дьявола или уравнитель голосов? Эффективные ИИ-напарники могут различаться в зависимости от сценариев сотрудничества

-

ИИ может играть различные роли в командах, отражая функциональные роли из классической теории групп (Benne & Sheats, 1948), чтобы улучшить сотрудничество в зависимости от сценария.

-

Siemon (2022) выделяет четыре прототипические роли, которые люди хотели бы видеть у ИИ-агентов в командах: Координатор, Создатель, Перфекционист, Исполнитель.

-

Chiang et al. (2024) показывают, что введение большой языковой модели (LLM) в качестве адвоката дьявола в процесс принятия решений группой значительно улучшает адекватную зависимость команды от ИИ-помощника. Эта роль также может помочь усилить голоса меньшинств (Lee et al., 2025).

-

В целом, различные условия сотрудничества выигрывают от разного поведения ИИ, и ни одна отдельная ИИ-персона не подходит всем командам.

-